Квази-Монте-Карло метод - Quasi-Monte Carlo method

В числовой анализ, то квази-Монте-Карло метод это метод для численное интегрирование и решение некоторых других задач с помощью последовательности с низким расхождением (также называемые квазислучайными последовательностями или субслучайными последовательностями). Это в отличие от обычного Метод Монте-Карло или же Интеграция Монте-Карло, основанные на последовательностях псевдослучайный числа.

Аналогично формулируются методы Монте-Карло и квази-Монте-Карло. Задача состоит в приближении интеграла от функции ж как среднее значение функции, оцененной в наборе точек Икс1, ..., ИксN:

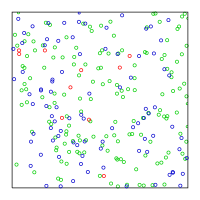

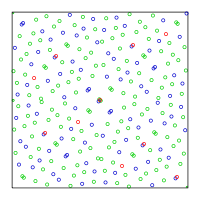

Поскольку мы интегрируем по s-мерный единичный куб, каждый Икся вектор s элементы. Разница между квази-Монте-Карло и Монте-Карло заключается в том, как Икся выбраны. Квази-Монте-Карло использует последовательность с низким расхождением, такую как Последовательность Холтона, то Последовательность Соболя, или последовательность Фора, тогда как Монте-Карло использует псевдослучайную последовательность. Преимущество использования последовательностей с низким расхождением - более высокая скорость сходимости. Квази-Монте-Карло имеет скорость сходимости, близкую к O (1 /N), тогда как ставка для метода Монте-Карло - O (N−0.5).[1]

Метод квази-Монте-Карло недавно стал популярным в области математические финансы или же вычислительные финансы.[1] В этих областях часто встречаются числовые интегралы большой размерности, где интеграл следует оценивать в пределах порогового значения ε. Следовательно, в этих ситуациях полезны методы Монте-Карло и квази-Монте-Карло.

Границы ошибки аппроксимации квази-Монте-Карло

Ошибка аппроксимации квази-Монте-Карло метода ограничена членом, пропорциональным невязке множества Икс1, ..., ИксN. В частности, Неравенство Коксмы – Главки. заявляет, что ошибка

ограничен

куда V(ж) - вариация Харди – Краузе функции ж (см. Morokoff and Caflisch (1995) [2] для подробных определений). DN - так называемая звездная невязка множества (Икс1,...,ИксN) и определяется как

куда Q прямоугольное тело в [0,1]s со сторонами, параллельными осям координат.[2] Неравенство можно использовать, чтобы показать, что ошибка аппроксимации методом квази-Монте-Карло составляет , а метод Монте-Карло имеет вероятностную ошибку . Хотя мы можем указать только верхнюю границу ошибки аппроксимации, скорость сходимости квази-Монте-Карло метода на практике обычно намного выше, чем его теоретическая оценка.[1] Следовательно, в целом точность метода квази-Монте-Карло повышается быстрее, чем точность метода Монте-Карло. Однако это преимущество гарантировано только в том случае, если N достаточно велико и если вариация конечна.

Монте-Карло и квази-Монте-Карло для многомерных интеграций

Для одномерного интегрирования квадратурные методы, такие как трапеция, Правило Симпсона, или же Формулы Ньютона – Котеса известны как эффективные, если функция гладкая. Эти подходы можно также использовать для многомерного интегрирования путем повторения одномерных интегралов по нескольким измерениям. Однако количество вычислений функций растет экспоненциально по мере увеличенияs, количество измерений увеличивается. Следовательно, метод, который может преодолеть это проклятие размерности следует использовать для многомерных интеграций. Стандартный метод Монте-Карло часто используется, когда квадратурные методы сложно или дорого реализовать.[2] Методы Монте-Карло и квази-Монте-Карло точны и относительно быстры, когда размерность велика, до 300 и выше.[3]

Мороков и Кафлиш [2] изучал производительность методов Монте-Карло и квази-Монте-Карло для интегрирования. В статье последовательности Халтона, Соболя и Фора для квази-Монте-Карло сравниваются со стандартным методом Монте-Карло с использованием псевдослучайных последовательностей. Они обнаружили, что последовательность Халтона лучше всего работает для размеров до 6; последовательность Соболя лучше всего подходит для более высоких измерений; и последовательность Faure, хотя и уступает двум другим, все же работает лучше, чем псевдослучайная последовательность.

Однако Мороков и Кафлиш [2] привел примеры, когда преимущество квази-Монте-Карло меньше, чем ожидалось теоретически. Тем не менее, в примерах, изученных Мороковым и Кафлишем, метод квази-Монте-Карло действительно дал более точный результат, чем метод Монте-Карло с тем же числом точек. Мороков и Кафлиш замечают, что преимущество метода квази-Монте-Карло тем больше, если подынтегральное выражение гладкое, а количество измерений s интеграла мала.

Недостатки квази-Монте-Карло

Лемье упомянул о недостатках квази-Монте-Карло:[4]

- Для того чтобы быть меньше чем , должен быть маленьким и должен быть большим (например, ). Для больших s и практичный N значений, расхождение набора точек из генератора с низким расхождением может быть не меньше, чем для случайного набора.

- Для многих функций, возникающих на практике, (например, если используются гауссовские переменные).

- Нам известна только верхняя граница ошибки (т. Е. ε ≤ V(ж) DN) и трудно вычислить и .

Чтобы преодолеть некоторые из этих трудностей, мы можем использовать рандомизированный квази-Монте-Карло метод.

Рандомизация квази-Монте-Карло

Поскольку последовательности с низким расхождением не случайны, а детерминированы, квази-Монте-Карло метод можно рассматривать как детерминированный алгоритм или дерандомизированный алгоритм. В этом случае у нас есть только оценка (например, ε ≤ V(ж) DN) на ошибку, и ее трудно оценить. Чтобы восстановить нашу способность анализировать и оценивать дисперсию, мы можем рандомизировать метод (см. рандомизация для общего представления). Полученный метод называется рандомизированным квази-методом Монте-Карло и может также рассматриваться как метод уменьшения дисперсии для стандартного метода Монте-Карло.[5] Среди нескольких методов самая простая процедура преобразования - случайное смещение. Позволять {Икс1,...,ИксN} будет точкой, установленной из последовательности с низким расхождением. Мы пробуем s-мерный случайный вектор U и смешать с {Икс1, ..., ИксN}. Подробно по каждому Иксj, Создайте

и используйте последовательность вместо того . Если у нас есть р репликации для Монте-Карло, выборка s-мерного случайного вектора U для каждой репликации. Рандомизация позволяет оценить дисперсию при использовании квазислучайных последовательностей. По сравнению с чистым квази-Монте-Карло количество выборок квазислучайной последовательности будет разделено на р за эквивалентные вычислительные затраты, что снижает теоретическую скорость сходимости. По сравнению со стандартным методом Монте-Карло дисперсия и скорость вычислений немного лучше экспериментальных результатов в Tuffin (2008). [6]

Смотрите также

- Метод Монте-Карло

- Методы Монте-Карло в финансах

- Квази-Монте-Карло методы в финансах

- Биология метод Монте-Карло

- Вычислительная физика

- Последовательности с низким расхождением

- Теория несоответствия

- Цепь Маркова Монте-Карло

Рекомендации

- ^ а б c Сорен Асмюссен и Питер В. Глинн, Стохастическое моделирование: алгоритмы и анализ, Springer, 2007, 476 стр.

- ^ а б c d е Уильям Дж. Морокофф и Рассел Э. Кафлиш, Квази-Монте-Карло интеграция, J. Comput. Phys. 122 (1995), нет. 2, 218–230. (В CiteSeer: [1] )

- ^ Рудольф Шюрер, Сравнение методов (квази) Монте-Карло и кубатурных правил для решения задач интегрирования большой размерности, Математика и компьютеры в моделировании, том 62, выпуски 3–6, 3 марта 2003 г., 509–517

- ^ Кристиан Лемье, Монте-Карло и квази-Монте-Карло выборка, Springer, 2009, ISBN 978-1441926760

- ^ Моше Дрор, Пьер Л’Экуайер и Ференц Сидаровски, Неопределенность моделирования: исследование стохастической теории, методов и приложений, Springer 2002, стр. 419-474.

- ^ Бруно Таффин, Рандомизация квази-Монте-Карло методов оценки ошибок: обзор и нормальная аппроксимация, Методы Монте-Карло и их приложения mcma. Том 10, выпуск 3-4, страницы 617–628, ISSN (онлайн) 1569-3961, ISSN (печатный) 0929-9629, DOI: 10.1515 / mcma.2004.10.3-4.617, май 2008 г.

- Р. Э. Кафлиш, Монте-Карло и квази-Монте-Карло методы, Acta Numerica vol. 7, Cambridge University Press, 1998, стр. 1–49.

- Йозеф Дик и Фридрих Пиллихсхаммер, Цифровые сети и последовательности. Теория несоответствия и квази-Монте-Карло интеграция, Cambridge University Press, Кембридж, 2010 г., ISBN 978-0-521-19159-3

- Гюнтер Леобахер и Фридрих Пиллихсхаммер, Введение в интеграцию и приложения квази-Монте-Карло, Компактные учебники по математике, Биркхойзер, 2014, ISBN 978-3-319-03424-9

- Майкл Дрмота и Роберт Ф. Тичи, Последовательности, расхождения и приложения, Конспект лекций по математике, 1651, Springer, Берлин, 1997, ISBN 3-540-62606-9

- Уильям Дж. Морокофф и Рассел Э. Кафлиш, Квазислучайные последовательности и их расхождения, SIAM J. Sci. Comput. 15 (1994), нет. 6, 1251–1279 (В CiteSeer:[2] )

- Харальд Нидеррайтер. Генерация случайных чисел и методы квази-Монте-Карло. Общество промышленной и прикладной математики, 1992. ISBN 0-89871-295-5

- Харальд Г. Нидеррайтер, Квази-Монте-Карло методы и псевдослучайные числа, Бык. Амер. Математика. Soc. 84 (1978), нет. 6, 957–1041

- Ото Штраух и Штефан Порубски, Распределение последовательностей: семплер, Издательство Питера Ланга, Франкфурт-на-Майне 2005 г., ISBN 3-631-54013-2

![int _ {{[0,1] ^ {s}}} f (u) , {{ rm {d}}} u приблизительно { frac {1} {N}} , sum _ { {i = 1}} ^ {N} f (x_ {i}).](https://wikimedia.org/api/rest_v1/media/math/render/svg/28359218161a6c30086f6a1bf782ec52f6afedee)

![{ Displaystyle varepsilon = left | int _ {[0,1] ^ {s}} f (u) , { rm {d}} u - { frac {1} {N}} , sum _ {i = 1} ^ {N} f (x_ {i}) right |}](https://wikimedia.org/api/rest_v1/media/math/render/svg/50a4320dba9be1ede6df887d6fe89c52bff6f7a9)

![{ displaystyle D_ {N} = sup _ {Q subset [0,1] ^ {s}} left | { frac {{ text {количество точек в}} Q} {N}} - имя оператора {объем} (Q) right |,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/64cb617a944c49e0f04f654b13bbc65e2781f176)