Научно-исследовательский институт машинного интеллекта - Machine Intelligence Research Institute

| |

| Формирование | 2000 |

|---|---|

| Тип | Некоммерческая исследовательский институт |

| Цель | Исследования в дружественный искусственный интеллект и Проблема управления AI |

| Место расположения | |

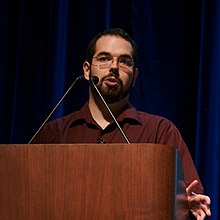

Ключевые люди | Элиэзер Юдковски |

| Интернет сайт | интеллект |

В Научно-исследовательский институт машинного интеллекта (МИРИ), ранее Сингулярность Институт искусственного интеллекта (SIAI), это некоммерческий исследовательский институт с 2005 г. сосредоточена на выявлении и управлении потенциалом экзистенциальные риски от общего искусственного интеллекта. Работа MIRI сосредоточена на дружелюбный ИИ подход к проектированию систем и прогнозированию темпов развития технологий.

История

В 2000 г. Элиэзер Юдковски основал Сингулярный институт искусственного интеллекта при финансовой поддержке Брайана и Сабин Аткинс с целью ускорения разработки искусственный интеллект (AI).[1][2][3] Однако Юдковски начал беспокоиться о том, что системы искусственного интеллекта, разработанные в будущем, могут стать сверхразумный и представляют опасность для человечества,[1] а в 2005 году институт переехал в Кремниевую долину и начал уделять особое внимание способам выявления и управления этими рисками, которые в то время в значительной степени игнорировались учеными в этой области.[2]

С 2006 года институт организовал Саммит Сингулярности обсудить будущее ИИ, включая его риски, первоначально в сотрудничестве с Стэндфордский Университет и с финансированием от Питер Тиль. В Хроники Сан-Франциско описал первую конференцию как «вечеринку в области залива для вдохновленной технологиями философии под названием трансгуманизм».[4][5] В 2011 году его офисы представляли собой четыре квартиры в центре Беркли.[6] В декабре 2012 года институт продал свое имя, веб-домен и саммит Singularity компании Университет сингулярности,[7] и в следующем месяце получил название «Научно-исследовательский институт машинного интеллекта».[8]

В 2014 и 2015 годах общественный и научный интерес к рискам ИИ вырос, что привело к увеличению пожертвований на финансирование исследований в MIRI и аналогичных организациях.[3][9]:327

В 2019 г. Открытая филантропия рекомендовал MIRI грант на общую поддержку в размере около 2,1 миллиона долларов на два года.[10] В апреле 2020 года Open Philanthropy дополнила это грантом в размере 7,7 миллиона долларов на два года.[11][12]

Исследования и подход

Подход MIRI к выявлению и управлению рисками ИИ, возглавляемый Юдковски, в первую очередь касается разработки дружественного ИИ, охватывающего как первоначальный дизайн систем ИИ, так и создание механизмов, гарантирующих, что развивающиеся системы ИИ остаются дружественными.[3][13][14]

Исследователи MIRI выступают за раннюю безопасную работу в качестве меры предосторожности.[15] Однако исследователи МИРИ скептически относятся к взглядам сторонники сингулярности подобно Рэй Курцвейл который сверхразум "не за горами".[13] MIRI финансирует работу по прогнозированию в рамках инициативы под названием AI Impacts, которая изучает исторические примеры прерывистых технологических изменений и разработала новые меры относительной вычислительной мощности людей и компьютерного оборудования.[16]

MIRI придерживается принципов и целей эффективный альтруизм движение.[17]

Работы сотрудников МИРИ

- Грейвс, Мэтью (8 ноября 2017 г.). «Почему нам следует беспокоиться об искусственном суперинтеллекте». Скептик. Общество скептиков. Получено 28 июля 2018.

- Лавиктуар, Патрик; Фалленштейн, Беня; Юдковский, Элиэзер; Барас, Михай; Кристиано, Пол; Херрешофф, Марчелло (2014). «Программное равновесие в дилемме заключенного через теорему Лёба». Мультиагентное взаимодействие без предварительной координации: материалы семинара AAAI-14. Публикации AAAI.

- Соарес, Нейт; Левинштейн, Бенджамин А. (2017). «Обман смерти в Дамаске» (PDF). Семинар по формальной эпистемологии (FEW). Получено 28 июля 2018.

- Соарес, Нейт; Фалленштейн, Беня; Юдковский, Элиэзер; Армстронг, Стюарт (2015). «Корректность». Семинары AAAI: семинары на Двадцать девятой конференции AAAI по искусственному интеллекту, Остин, Техас, 25–26 января 2015 г.. Публикации AAAI.

- Соарес, Нейт; Фалленштейн, Беня (2015). "Согласование суперинтеллекта с интересами человека: программа технических исследований" (PDF). Миллер, Джеймс; Ямпольский, Роман; Армстронг, Стюарт; и другие. (ред.). Технологическая сингулярность: управление путешествием. Springer.

- Юдковский, Элиэзер (2008). «Искусственный интеллект как положительный и отрицательный фактор глобального риска» (PDF). В Бостром, Ник; Жиркович, Милан (ред.). Глобальные катастрофические риски. Издательство Оксфордского университета. ISBN 978-0199606504.

- Тейлор, Джессика (2016). «Квантилизаторы: более безопасная альтернатива максимизаторам для ограниченной оптимизации». Семинары на тридцатой конференции AAAI по искусственному интеллекту.

- Юдковский, Элиэзер (2011). «Сложные системы ценностей в дружественном ИИ» (PDF). Общий искусственный интеллект: 4-я Международная конференция, AGI 2011, Маунтин-Вью, Калифорния, США, 3–6 августа 2011 г.. Берлин: Springer.

Смотрите также

- Институт искусственного интеллекта Аллена

- Институт будущего человечества

- Институт этики и новых технологий

Рекомендации

- ^ а б «MIRI: Искусственный интеллект: опасность добрых намерений - институт будущего жизни». Институт будущего жизни. 11 октября 2015.

- ^ а б Хатчадурян, Раффи. «Изобретение судного дня». Житель Нью-Йорка.

- ^ а б c Уотерс, Ричард (31 октября 2014 г.). «Искусственный интеллект: машина против человека». Financial Times. Получено 27 августа 2018.

- ^ Abate, Том (2006). "Умнее тебя?". Хроники Сан-Франциско. Получено 12 октября 2015.

- ^ Abate, Том (2007). «Общественное собрание пересмотрит будущее искусственного интеллекта». Хроники Сан-Франциско. Получено 12 октября 2015.

- ^ Касте, Мартин (11 января 2011 г.). "Сингулярность: последнее изобретение человечества?". Все учтено, NPR.

- ^ «Пресс-релиз: Singularity University достигает вершины Singularity». Университет сингулярности. 9 декабря 2012 г.

- ^ "Пресс-релиз: Мы теперь" Научно-исследовательский институт машинного интеллекта "(МИРИ) - Исследовательский институт машинного интеллекта". Научно-исследовательский институт машинного интеллекта. 30 января 2013 г.

- ^ Тегмарк, Макс (2017). Life 3.0: Быть человеком в эпоху искусственного интеллекта. Соединенные Штаты: Knopf. ISBN 978-1-101-94659-6.

- ^ «Научно-исследовательский институт машинного интеллекта - Общая поддержка (2019)». Открытый проект благотворительности. 2019-03-29. Получено 2019-10-08.

- ^ "Научно-исследовательский институт машинного интеллекта - Общая поддержка (2020)". Открыть проект благотворительности. В архиве с оригинала 13 апреля 2020 г.

- ^ Бенсингер, Роб (27 апреля 2020 г.). «Самый крупный грант МИРИ на сегодняшний день!». МИРИ.

- ^ а б ЛаФранс, Адриенн (2015). «Создание роботов с более высокими моральными качествами, чем у людей». Атлантический океан. Получено 12 октября 2015.

- ^ Рассел, Стюарт; Норвиг, Питер (2009). Искусственный интеллект: современный подход. Прентис Холл. ISBN 978-0-13-604259-4.

- ^ Сатиан, Санджена (4 января 2016 г.). «Самые важные философы нашего времени проживают в Кремниевой долине». ОЗИ. ОЗИ. Получено 28 июля 2018.

- ^ Сюй, Джереми (2015). "Убедиться в быстром росте ИИ не удивительно". Обнаружить. Получено 12 октября 2015.

- ^ «ИИ и эффективный альтруизм». Научно-исследовательский институт машинного интеллекта. 2015-08-28. Получено 2019-10-08.

дальнейшее чтение

- Рассел, Стюарт; Дьюи, Дэниел; Тегмарк, Макс (зима 2015 г.). «Приоритеты исследований для надежного и эффективного искусственного интеллекта». Журнал AI. 36 (4): 6. arXiv:1602.03506. Bibcode:2016arXiv160203506R.