Глубокое обучение - Deep learning

| Часть серии по |

| Машинное обучение и сбор данных |

|---|

Площадки для машинного обучения |

| Часть серии по |

| Искусственный интеллект |

|---|

Технологии |

Глоссарий |

Глубокое обучение (также известный как глубокое структурированное обучение) является частью более широкого семейства машинное обучение методы, основанные на искусственные нейронные сети с репрезентативное обучение. Обучение может быть под наблюдением, полууправляемый или же без присмотра.[1][2][3]

Архитектуры глубокого обучения, такие как глубокие нейронные сети, сети глубоких убеждений, повторяющиеся нейронные сети и сверточные нейронные сети были применены к полям, включая компьютерное зрение, машинное зрение, распознавание речи, обработка естественного языка, распознавание звука, фильтрация социальных сетей, машинный перевод, биоинформатика, дизайн лекарства, анализ медицинских изображений, проверка материалов и настольная игра программы, в которых они дали результаты, сопоставимые, а в некоторых случаях и превосходящие возможности специалистов.[4][5][6]

Искусственные нейронные сети (ИНС) были вдохновлены обработкой информации и распределенными коммуникационными узлами в биологические системы. ИНС имеют различные отличия от биологических. мозги. В частности, нейронные сети обычно статичны и символичны, в то время как биологический мозг большинства живых организмов является динамическим (пластичным) и аналоговым.[7][8][9]

Прилагательное «глубокий» в глубоком обучении происходит от использования нескольких уровней в сети. Ранние работы показали, что линейный перцептрон не может быть универсальным классификатором, и тогда сеть с неполиномиальной функцией активации с одним скрытым слоем неограниченной ширины, с другой стороны, может быть таковой. Глубокое обучение - это современная разновидность, которая связана с неограниченным количеством слоев ограниченного размера, что допускает практическое применение и оптимизированную реализацию, сохраняя теоретическую универсальность в мягких условиях. В глубоком обучении слоям также разрешено быть неоднородными и сильно отклоняться от биологически информированных. коннекционист модели, ради эффективности, обучаемости и понятности, откуда «структурированная» часть.

Определение

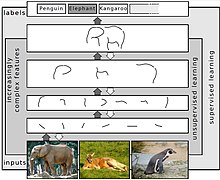

Глубокое обучение - это класс машинное обучение алгоритмы который[11](pp199–200) использует несколько слоев для постепенного извлечения высокоуровневых функций из необработанных входных данных. Например, в обработка изображений нижние уровни могут идентифицировать края, в то время как более высокие уровни могут идентифицировать понятия, относящиеся к человеку, такие как цифры, буквы или лица.

Обзор

Большинство современных моделей глубокого обучения основаны на искусственные нейронные сети, конкретно сверточные нейронные сети (CNN) s, хотя они также могут включать пропозициональные формулы или скрытые переменные, организованные послойно в глубоких генеративные модели такие как узлы в сети глубоких убеждений и глубоко Машины Больцмана.[12]

В глубоком обучении каждый уровень учится преобразовывать свои входные данные в несколько более абстрактное и составное представление. В приложении для распознавания изображений необработанный ввод может быть матрица пикселей; первый репрезентативный слой может абстрагировать пиксели и кодировать края; второй слой может составлять и кодировать расположение краев; третий слой может кодировать нос и глаза; а четвертый слой может распознать, что изображение содержит лицо. Важно отметить, что в процессе глубокого обучения можно узнать, какие функции оптимально разместить на каком уровне. сам по себе. (Конечно, это не полностью устраняет необходимость ручной настройки; например, различное количество слоев и размеры слоев могут обеспечить разную степень абстракции.)[1][13]

Слово «глубокий» в «глубоком обучении» относится к количеству уровней, через которые преобразуются данные. Точнее, системы глубокого обучения имеют существенное путь присвоения кредита (CAP) глубина. CAP - это цепочка преобразований от ввода к выводу. CAP описывают потенциально причинные связи между вводом и выводом. Для нейронная сеть с прямой связью, глубина CAP равна глубине сети и равна количеству скрытых слоев плюс один (поскольку выходной уровень также параметризован). За повторяющиеся нейронные сети, в котором сигнал может распространяться через слой более одного раза, глубина CAP потенциально не ограничена.[2] Нет общепризнанного порога глубины, который отделяет поверхностное обучение от глубокого, но большинство исследователей согласны с тем, что глубокое обучение предполагает глубину CAP выше 2. Было показано, что CAP глубины 2 является универсальным приближением в том смысле, что может имитировать любую функцию. .[14] Кроме того, большее количество слоев не увеличивает аппроксимирующую способность сети. Глубокие модели (CAP> 2) способны извлекать лучшие функции, чем мелкие модели, и, следовательно, дополнительные слои помогают эффективно изучать функции.

Архитектуры глубокого обучения могут быть построены с жадный послойный метод.[15] Глубокое обучение помогает распутать эти абстракции и выбрать, какие функции улучшают производительность.[1]

За контролируемое обучение задачи, методы глубокого обучения устраняют разработка функций, переводя данные в компактные промежуточные представления, похожие на основные компоненты, и получить многоуровневые структуры, устраняющие избыточность в представлении.

Алгоритмы глубокого обучения могут применяться к задачам обучения без учителя. Это важное преимущество, потому что немаркированных данных больше, чем помеченных данных. Примерами глубоких структур, которые можно обучить неконтролируемым образом, являются компрессоры нейронной истории.[16] и сети глубоких убеждений.[1][17]

Интерпретации

Эта секция может содержать чрезмерное количество цитирований. (Июнь 2020 г.) (Узнайте, как и когда удалить этот шаблон сообщения) |

Глубинные нейронные сети обычно интерпретируются с точки зрения универсальная аппроксимационная теорема[18][19][20][21][22] или же вероятностный вывод.[11][12][1][2][17][23]

Классическая универсальная аппроксимационная теорема касается способности нейронные сети с прямой связью с одним скрытым слоем конечного размера для приблизительного непрерывные функции.[18][19][20][21] В 1989 г. первое доказательство было опубликовано Георгий Цибенко за сигмовидный функции активации[18][нужна цитата ] и был обобщен Куртом Хорником в 1991 г. на многоуровневые архитектуры с прямой связью.[19] Недавняя работа также показала, что универсальное приближение также справедливо для неограниченных функций активации, таких как выпрямленная линейная единица.[24]

Универсальная аппроксимационная теорема для глубокие нейронные сети касается пропускной способности сетей с ограниченной шириной, но глубина может увеличиваться. Лу и др.[22] доказал, что если ширина глубокая нейронная сеть с ReLU активация строго превышает размер ввода, тогда сеть может аппроксимировать любую Интегрируемая функция Лебега; Если ширина меньше или равна входному размеру, то глубокая нейронная сеть не универсальный аппроксиматор.

В вероятностный интерпретация[23] происходит из области машинное обучение. Он имеет вывод,[11][12][1][2][17][23] так же хорошо как оптимизация концепции обучение персонала и тестирование, связанных с примеркой и обобщение, соответственно. В частности, вероятностная интерпретация рассматривает активационную нелинейность как кумулятивная функция распределения.[23] Вероятностная интерпретация привела к введению выбывать в качестве регуляризатор в нейронных сетях.[25] Вероятностная интерпретация была введена исследователями, в том числе Hopfield, Widrow и Нарендра и популяризируется в опросах, таких как Епископ.[26]

История

Первый общий рабочий алгоритм обучения для контролируемого, глубокого, упреждающего, многоуровневого перцептроны был опубликован Алексей Ивахненко и Лапа в 1967 году.[27] В статье 1971 года описана глубокая сеть с восемью слоями, обученная групповой метод обработки данных.[28] Другие рабочие архитектуры глубокого обучения, в частности, созданные для компьютерное зрение, началось с Неокогнитрон представлен Кунихико Фукусима в 1980 г.[29]

Период, термин Глубокое обучение был представлен сообществу машинного обучения Рина Дечтер в 1986 г.[30][16] и чтобы искусственные нейронные сети Игоря Айзенберга и его коллег в 2000 г. в контексте Булево пороговые нейроны.[31][32]

В 1989 г. Янн ЛеКун и другие. применил стандарт обратное распространение алгоритм, который раньше был обратным режимом автоматическая дифференциация с 1970 г.[33][34][35][36] в глубокую нейронную сеть с целью распознавание рукописных почтовых индексов по почте. Пока алгоритм работал, на обучение ушло 3 дня.[37]

К 1991 году такие системы использовались для распознавания отдельных двумерных рукописных цифр, в то время как распознавание трехмерных объектов было сделано путем сопоставления двухмерных изображений с созданной вручную трехмерной объектной моделью. Weng и другие. предположили, что человеческий мозг не использует монолитную трехмерную объектную модель, и в 1992 году они опубликовали Cresceptron,[38][39][40] метод распознавания трехмерных объектов в загроможденных сценах. Поскольку он напрямую использовал естественные изображения, Cresceptron положил начало универсальному визуальному обучению естественным трехмерным мирам. Крецептрон - это каскад слоев, подобных неокогнитрону. Но в то время как Neocognitron требовал человека-программиста для ручного слияния функций, Cresceptron изучил открытое количество функций на каждом уровне без надзора, где каждая функция представлена ядро свертки. Крецептрон сегментировал каждый изученный объект из загроможденной сцены посредством обратного анализа по сети. Максимальное объединение, теперь часто применяемые глубокими нейронными сетями (например, ImageNet tests), был впервые использован в Cresceptron для уменьшения разрешения положения в раз (2x2) до 1 с помощью каскада для лучшего обобщения.

В 1994 году Андре де Карвалью вместе с Майком Фэрхерстом и Дэвидом Биссетом опубликовали экспериментальные результаты многослойной логической нейронной сети, также известной как невесомая нейронная сеть, состоящая из трехуровневого самоорганизующегося модуля нейронной сети для извлечения признаков ( SOFT), за которым последовал модуль нейронной сети с многоуровневой классификацией (GSN), которые прошли независимое обучение. Каждый слой в модуле извлечения признаков извлекал объекты с возрастающей сложностью по сравнению с предыдущим слоем.[41]

В 1995 г. Брендан Фрей продемонстрировали, что можно обучить (в течение двух дней) сеть, содержащую шесть полностью связанных слоев и несколько сотен скрытых блоков, используя алгоритм бодрствования-сна, разработан совместно с Питер Даян и Хинтон.[42] Многие факторы способствуют низкой скорости, в том числе проблема исчезающего градиента проанализированы в 1991 г. Зепп Хохрайтер.[43][44]

С 1997 года Свен Бенке расширил иерархический сверточный подход с прямой связью в пирамиде нейронных абстракций.[45] боковыми и обратными связями, чтобы гибко включать контекст в решения и итеративно разрешать локальные неоднозначности.

Более простые модели, в которых используются специальные функции ручной работы, такие как Фильтры Gabor и опорные векторные машины (SVM) были популярным выбором в 1990-х и 2000-х годах из-за искусственная нейронная сеть вычислительные затраты (ИНС) и непонимание того, как мозг связывает свои биологические сети.

Как поверхностное, так и глубокое обучение (например, повторяющиеся сети) ИНС изучаются в течение многих лет.[46][47][48] Эти методы никогда не превосходили неоднородные гауссианы, созданные вручную. модель смеси /Скрытая марковская модель (GMM-HMM) технология, основанная на генеративных моделях речи, обучаемых избирательно.[49] Были проанализированы ключевые трудности, включая уменьшение градиента[43] и слабая временная корреляционная структура в нейронных прогностических моделях.[50][51] Дополнительные трудности заключались в отсутствии обучающих данных и ограниченных вычислительных мощностях.

Наиболее распознавание речи исследователи отошли от нейронных сетей и занялись генеративным моделированием. Исключение было на SRI International в конце 1990-х гг. Финансируется правительством США АНБ и DARPA, SRI изучала глубокие нейронные сети в распознавании речи и говорящего. Команда по распознаванию спикеров во главе с Ларри Хек сообщили о значительном успехе глубоких нейронных сетей в обработке речи в 1998 г. Национальный институт стандартов и технологий Оценка узнаваемости спикера.[52] Затем глубокая нейронная сеть SRI была развернута в Nuance Verifier, что стало первым крупным промышленным приложением глубокого обучения.[53]

Принцип повышения «сырых» функций над ручной оптимизацией был впервые успешно исследован в архитектуре глубокого автоэнкодера на «сырой» спектрограмме или функциях линейного банка фильтров в конце 1990-х годов.[53] демонстрируя свое превосходство над функциями Mel-Cepstral, которые содержат этапы фиксированного преобразования из спектрограмм. Необработанные черты речи, формы волны, позже дал отличные крупномасштабные результаты.[54]

Многие аспекты распознавания речи были переработаны методом глубокого обучения под названием долговременная кратковременная память (LSTM), рекуррентная нейронная сеть, опубликованная Hochreiter и Шмидхубер в 1997 г.[55] LSTM RNN избегают проблемы исчезающего градиента и могут изучать задачи «очень глубокого обучения»[2] которые требуют воспоминаний о событиях, которые произошли за тысячи дискретных временных шагов раньше, что важно для речи. В 2003 году LSTM начал конкурировать с традиционными распознавателями речи при выполнении определенных задач.[56] Позже она была объединена с коннекционистской временной классификацией (CTC).[57] в стеках LSTM RNN.[58] Сообщается, что в 2015 году производительность распознавания речи Google резко выросла на 49% благодаря обученному CTC LSTM, который они сделали доступным через Google Voice Search.[59]

В 2006 г. публикации Джефф Хинтон, Руслан Салахутдинов, Осиндеро и Тех[60][61][62] показал, насколько многослойным нейронная сеть с прямой связью можно эффективно предварительно обучать по одному слою за раз, обрабатывая каждый слой по очереди как неконтролируемый ограниченная машина Больцмана, а затем настройте его с помощью контролируемых обратное распространение.[63] В документах упоминается учусь за сети глубоких убеждений.

Глубокое обучение является частью современных систем в различных дисциплинах, особенно в области компьютерного зрения и автоматическое распознавание речи (ASR). Результаты по часто используемым оценочным наборам, таким как ТИМИТ (ASR) и MNIST (классификация изображений ), а также ряд задач распознавания речи с большим словарным запасом постоянно совершенствовались.[64][65][66] Сверточные нейронные сети (CNN) были заменены на ASR на CTC[57] для LSTM.[55][59][67][68][69][70][71] но более успешны в области компьютерного зрения.

По словам Яна Лекуна, влияние глубокого обучения на промышленность началось в начале 2000-х годов, когда CNN уже обработали от 10% до 20% всех проверок, выписанных в США.[72] Промышленное применение глубокого обучения для крупномасштабного распознавания речи началось примерно в 2010 году.

Семинар NIPS 2009 г. по глубокому обучению для распознавания речи[73] был мотивирован ограничениями глубинных генеративных моделей речи и возможностью того, что при наличии более мощного оборудования и крупномасштабных наборов данных глубокие нейронные сети (DNN) могут стать практичными. Считалось, что предварительное обучение DNN с использованием генеративных моделей сетей глубокого убеждения (DBN) преодолеет основные трудности нейронных сетей.[74] Однако было обнаружено, что замена предварительного обучения большими объемами обучающих данных для простого обратное распространение при использовании DNN с большими, зависимыми от контекста выходными слоями частота ошибок значительно ниже, чем у современной модели смеси Гаусса (GMM) / Hidden Markov Model (HMM), а также чем у более совершенных систем на основе генеративных моделей .[64][75] Природа ошибок распознавания, создаваемых системами двух типов, была характерно различной.[76][73] предлагает техническую информацию о том, как интегрировать глубокое обучение в существующую высокоэффективную систему декодирования речи во время выполнения, используемую всеми основными системами распознавания речи.[11][77][78] Анализ 2009–2010 годов, сравнивающий GMM (и другие модели генеративной речи) с моделями DNN, стимулировал ранние промышленные инвестиции в глубокое обучение для распознавания речи,[76][73] в конечном итоге привело к повсеместному и доминирующему использованию в этой отрасли. Этот анализ был проведен с сопоставимой производительностью (менее 1,5% с частотой ошибок) между дискриминантными DNN и генеративными моделями.[64][76][74][79]

В 2010 году исследователи расширили глубокое обучение с TIMIT до распознавания речи с большим словарным запасом, приняв большие выходные уровни DNN на основе контекстно-зависимых состояний HMM, построенных с помощью деревья решений.[80][81][82][77]

Достижения в области аппаратного обеспечения возродили интерес к глубокому обучению. В 2009, Nvidia был вовлечен в так называемый «большой взрыв» глубокого обучения, «поскольку нейронные сети глубокого обучения обучались с помощью Nvidia. графические процессоры (GPU) ».[83] Этот год, Эндрю Нг определили, что графические процессоры могут увеличить скорость систем глубокого обучения примерно в 100 раз.[84] В частности, графические процессоры хорошо подходят для матричных / векторных вычислений, связанных с машинным обучением.[85][86][87] Графические процессоры ускоряют алгоритмы обучения на порядки, сокращая время работы с недель до дней.[88][89] Кроме того, для эффективной обработки моделей глубокого обучения можно использовать специализированное оборудование и оптимизацию алгоритмов.[90]

Революция глубокого обучения

В 2012 году команда под руководством Джорджа Э. Даля победила в конкурсе "Merck Molecular Activity Challenge", используя многозадачные глубокие нейронные сети для прогнозирования биомолекулярная мишень одного препарата.[91][92] В 2014 году группа Хохрайтера использовала глубокое обучение для обнаружения нецелевого и токсичного воздействия химических веществ из окружающей среды в питательных веществах, бытовых товарах и лекарствах и выиграла конкурс Tox21 Data Challenge Национальные институты здравоохранения США, FDA и NCATS.[93][94][95]

Значительные дополнительные воздействия на распознавание изображений или объектов ощущались в период с 2011 по 2012 годы. обратное распространение существовала уже несколько десятилетий, и реализации NN на GPU в течение многих лет, включая CNN, быстрые реализации CNN на GPU были необходимы для прогресса в области компьютерного зрения.[85][87][37][96][2] В 2011 году этот подход впервые продемонстрировал сверхчеловеческие способности в конкурсе по распознаванию визуальных образов. Также в 2011 году он выиграл конкурс китайского почерка ICDAR, а в мае 2012 года он выиграл конкурс сегментации изображений ISBI.[97] До 2011 года CNN не играли важной роли на конференциях по компьютерному зрению, но в июне 2012 года в статье Ciresan et al. на ведущей конференции CVPR[4] показали, как максимальное объединение CNN на GPU может значительно улучшить многие результаты тестов машинного зрения. В октябре 2012 года аналогичная система Крижевского и др.[5] выиграл крупномасштабный Конкурс ImageNet со значительным отрывом от поверхностных методов машинного обучения. В ноябре 2012 года система Чиресана и его соавторов также выиграла конкурс ICPR по анализу больших медицинских изображений для выявления рака, а в следующем году - также в конкурсе MICCAI Grand Challenge по той же теме.[98] В 2013 и 2014 годах частота ошибок в задаче ImageNet с использованием глубокого обучения была еще больше снижена, следуя аналогичной тенденции в крупномасштабном распознавании речи. В Вольфрам Эти улучшения были опубликованы в проекте Image Identification.[99]

Затем классификация изображений была расширена до более сложной задачи: создание описаний (подписи) для изображений, часто в виде комбинации CNN и LSTM.[100][101][102][103]

Некоторые исследователи утверждают, что победа ImageNet в октябре 2012 года положила начало «революции глубокого обучения», которая изменила индустрию искусственного интеллекта.[104]

В марте 2019 г. Йошуа Бенжио, Джеффри Хинтон и Янн ЛеКун были награждены Премия Тьюринга за концептуальные и инженерные прорывы, которые сделали глубокие нейронные сети важным компонентом вычислений.

Нейронные сети

Искусственные нейронные сети

Искусственные нейронные сети (ИНС) или же коннекционист системы вычислительные системы вдохновлены биологические нейронные сети которые составляют мозг животных. Такие системы учатся (постепенно улучшают свои способности) выполнять задачи, рассматривая примеры, как правило, без программирования для конкретных задач. Например, при распознавании изображений они могут научиться определять изображения, на которых изображены кошки, путем анализа примеров изображений, которые были вручную маркированный как «кошка» или «без кошки» и использование аналитических результатов для идентификации кошек на других изображениях. Они нашли наибольшее применение в приложениях, которые трудно выразить с помощью традиционного компьютерного алгоритма, использующего программирование на основе правил.

ИНС основана на наборе связанных единиц, называемых искусственные нейроны, (аналогично биологическим нейронам в биологический мозг ). Каждое соединение (синапс ) между нейронами может передавать сигнал другому нейрону. Принимающий (постсинаптический) нейрон может обрабатывать сигнал (ы), а затем передавать сигналы нижестоящим нейронам, связанным с ним. Нейроны могут иметь состояние, обычно представленное действительные числа, обычно от 0 до 1. Нейроны и синапсы также могут иметь вес, который изменяется по мере обучения, что может увеличивать или уменьшать силу сигнала, который они посылают ниже по потоку.

Обычно нейроны организованы по слоям. Разные слои могут выполнять разные виды преобразований на своих входах. Сигналы перемещаются от первого (входного) к последнему (выходному) слою, возможно, после многократного обхода слоев.

Первоначальная цель нейросетевого подхода состояла в том, чтобы решать проблемы так же, как это делает человеческий мозг. Со временем внимание сосредоточилось на сопоставлении определенных умственных способностей, что привело к отклонениям от биологии, таким как обратное распространение или передача информации в обратном направлении и настройка сети для отражения этой информации.

Нейронные сети использовались для решения множества задач, включая компьютерное зрение, распознавание речи, машинный перевод, социальная сеть фильтрация, играть в настольные и видеоигры и медицинский диагноз.

По состоянию на 2017 год нейронные сети обычно имеют от нескольких тысяч до нескольких миллионов единиц и миллионы соединений. Несмотря на то, что это число на несколько порядков меньше, чем количество нейронов в человеческом мозгу, эти сети могут выполнять многие задачи на уровне, превышающем человеческий (например, распознавание лиц, игра в «го»[105] ).

Глубокие нейронные сети

Эта секция может быть слишком техническим для большинства читателей, чтобы понять. Пожалуйста помогите улучшить это к сделать понятным для неспециалистов, не снимая технических деталей. (Июль 2016) (Узнайте, как и когда удалить этот шаблон сообщения) |

Глубокая нейронная сеть (DNN) - это искусственная нейронная сеть (ИНС) с несколькими слоями между входным и выходным слоями.[12][2] Существуют разные типы нейронных сетей, но они всегда состоят из одних и тех же компонентов: нейронов, синапсов, весов, смещений и функций.[106] Эти компоненты функционируют аналогично человеческому мозгу и могут быть обучены, как любой другой алгоритм машинного обучения.[нужна цитата ]

Например, DNN, который обучен распознавать породы собак, будет проходить по заданному изображению и вычислять вероятность того, что собака на изображении принадлежит определенной породе. Пользователь может просмотреть результаты и выбрать, какие вероятности должна отображать сеть (выше определенного порога и т. Д.), И вернуть предложенную метку. Каждая математическая манипуляция как таковая считается слоем, а сложные DNN имеют много уровней, отсюда и название «глубокие» сети.

DNN могут моделировать сложные нелинейные отношения. Архитектура DNN генерирует композиционные модели, в которых объект выражается как многоуровневая композиция примитивы.[107] Дополнительные слои позволяют составлять объекты из нижних слоев, потенциально моделируя сложные данные с меньшим количеством единиц, чем аналогичная по производительности мелкая сеть.[12]

Глубокие архитектуры включают множество вариантов нескольких основных подходов. Каждая архитектура добилась успеха в определенных областях. Не всегда возможно сравнивать производительность нескольких архитектур, если они не были оценены на одних и тех же наборах данных.

DNN обычно представляют собой сети с прямой связью, в которых данные передаются от входного уровня к выходному без обратной петли. Сначала DNN создает карту виртуальных нейронов и присваивает случайные числовые значения или «веса» связям между ними. Веса и входные данные умножаются и возвращают выходное значение от 0 до 1. Если сеть не может точно распознать конкретный образец, алгоритм будет корректировать веса.[108] Таким образом, алгоритм может повысить влияние определенных параметров до тех пор, пока он не определит правильные математические операции для полной обработки данных.

Рекуррентные нейронные сети (RNN), в которых данные могут передаваться в любом направлении, используются для таких приложений, как языковое моделирование.[109][110][111][112][113] Для этого особенно эффективна долговременная кратковременная память.[55][114]

Сверточные глубокие нейронные сети (CNN) используются в компьютерном зрении.[115] CNN также были применены к акустическое моделирование для автоматического распознавания речи (ASR).[71]

Вызовы

Как и в случае с ИНС, многие проблемы могут возникнуть с наивно обученными DNN. Две общие проблемы: переоснащение и время вычисления.

DNN склонны к переобучению из-за дополнительных уровней абстракции, которые позволяют им моделировать редкие зависимости в обучающих данных. Регуляризация такие методы, как единичная обрезка Ивахненко[28] или же снижение веса (-регуляризация) или редкость (-регуляризация) может применяться во время тренировок для борьбы с переобучением.[116] В качестве альтернативы регуляризация выпадения случайным образом исключает единицы из скрытых слоев во время обучения. Это помогает исключить редкие зависимости.[117] Наконец, данные могут быть увеличены с помощью таких методов, как обрезка и вращение, так что меньшие обучающие наборы могут быть увеличены в размере, чтобы снизить вероятность переобучения.[118]

DNN должны учитывать многие параметры обучения, такие как размер (количество слоев и количество единиц на уровне), скорость обучения, и начальные веса. Перемещение по пространству параметров для оптимальных параметров может оказаться невозможным из-за затрат времени и вычислительных ресурсов. Различные приемы, такие как пакетирование (вычисление градиента сразу на нескольких обучающих примерах, а не на отдельных примерах)[119] ускорить вычисления. Большие вычислительные возможности многоядерных архитектур (таких как графические процессоры или Intel Xeon Phi) привели к значительному ускорению обучения из-за пригодности таких архитектур обработки для матричных и векторных вычислений.[120][121]

В качестве альтернативы инженеры могут искать другие типы нейронных сетей с более простыми и конвергентными алгоритмами обучения. CMAC (контроллер артикуляции модели мозжечка ) - одна из таких нейронных сетей. Для CMAC не требуются скорости обучения или рандомизированные начальные веса. Можно гарантировать, что процесс обучения сойдется за один шаг с новым пакетом данных, а вычислительная сложность алгоритма обучения линейна по отношению к количеству задействованных нейронов.[122][123]

Аппаратное обеспечение

С 2010-х годов прогресс как в алгоритмах машинного обучения, так и в компьютерное железо привели к более эффективным методам обучения глубоких нейронных сетей, которые содержат много слоев нелинейных скрытых единиц и очень большой выходной слой.[124] К 2019 году графические процессоры (GPU ), часто с улучшениями, специфичными для ИИ, вытеснили ЦП как доминирующий метод обучения крупномасштабного коммерческого облачного ИИ.[125] OpenAI оценили объем аппаратных вычислений, используемых в крупнейших проектах глубокого обучения от AlexNet (2012 г.) до AlphaZero (2017 г.), и обнаружил, что объем требуемых вычислений увеличился в 300 000 раз, а график тренда времени удвоения составляет 3,4 месяца.[126][127]

Приложения

Автоматическое распознавание речи

Масштабное автоматическое распознавание речи - это первый и наиболее убедительный успешный пример глубокого обучения. LSTM RNN могут изучать задачи "очень глубокого обучения"[2] которые включают многосекундные интервалы, содержащие речевые события, разделенные тысячами дискретных временных шагов, где один временной шаг соответствует примерно 10 мс. LSTM с воротами забыть[114] конкурирует с традиционными распознавателями речи при выполнении определенных задач.[56]

Первоначальный успех в распознавании речи был основан на небольших задачах распознавания на основе TIMIT. Набор данных содержит 630 спикеров из восьми основных диалекты из Американский английский, где каждый говорящий читает 10 предложений.[128] Его небольшой размер позволяет опробовать множество конфигураций. Что еще более важно, задача TIMIT касается распознавания телефонной последовательности, которое, в отличие от распознавания последовательности слов, позволяет слабому телефону биграмма языковые модели. Это позволяет легче анализировать силу аспектов акустического моделирования распознавания речи. Перечисленные ниже коэффициенты ошибок, включая эти первые результаты и измеренные как процент ошибок по телефону (PER), были обобщены с 1991 года.

| Метод | Процент телефона коэффициент ошибок (PER) (%) |

|---|---|

| Случайно инициализированный RNN[129] | 26.1 |

| Байесовский трифон GMM-HMM | 25.6 |

| Модель скрытой траектории (генеративная) | 24.8 |

| Монофон, произвольно инициализированный DNN | 23.4 |

| Монофон ДБН-ДНН | 22.4 |

| Triphone GMM-HMM с обучением BMMI | 21.7 |

| Монофон ДБН-ДНН на fbank | 20.7 |

| Сверточный DNN[130] | 20.0 |

| Сверточная DNN w. Гетерогенное объединение | 18.7 |

| Ансамбль DNN / CNN / RNN[131] | 18.3 |

| Двунаправленный LSTM | 17.8 |

| Иерархическая сверточная сеть Deep Maxout[132] | 16.5 |

Дебют DNN для распознавания говорящих в конце 1990-х и распознавания речи в 2009-2011 гг. И LSTM в 2003-2007 гг. Ускорил прогресс в восьми основных областях:[11][79][77]

- Увеличение / уменьшение масштаба и ускоренное обучение и декодирование DNN

- Последовательность дискриминационного обучения

- Обработка признаков с помощью глубоких моделей с четким пониманием основных механизмов

- Адаптация DNN и связанных глубинных моделей

- Многозадачность и передача обучения по DNN и родственным глубоким моделям

- CNN и как спроектировать их для наилучшего использования базовые знания речи

- RNN и его богатые варианты LSTM

- Другие типы глубинных моделей, включая тензорные модели и интегрированные глубинные генеративные / дискриминативные модели.

Все основные коммерческие системы распознавания речи (например, Microsoft Кортана, Xbox, Переводчик Skype, Amazon Alexa, Google сейчас, Apple Siri, Baidu и iFlyTek голосовой поиск и ряд Нюанс речевые продукты и т. д.) основаны на глубоком обучении.[11][133][134]

Распознавание электромиографии (ЭМГ)

Электромиография (ЭМГ) сигналы широко используются для определения намерения пользователя потенциально управлять вспомогательными устройствами, такими как интеллектуальные инвалидные коляски, экзоскелеты и протезы. В прошлом веке использовалась плотная нейронная сеть прямого распространения. Затем исследователь использовал спектрограмма для отображения сигнала ЭМГ и последующего использования его в качестве входных данных для глубоких сверточных нейронных сетей. В последнее время сквозное глубокое обучение используется для непосредственного сопоставления необработанных сигналов с идентификацией намерений пользователя.[135]

Распознавание изображений

Обычным набором оценок для классификации изображений является набор данных базы данных MNIST. MNIST состоит из рукописных цифр и включает 60 000 обучающих примеров и 10 000 тестовых примеров. Как и в случае с TIMIT, его небольшой размер позволяет пользователям тестировать несколько конфигураций. Доступен исчерпывающий список результатов по этому набору.[136]

Распознавание изображений на основе глубокого обучения стало «сверхчеловеческим» и дает более точные результаты, чем участники соревнований. Впервые это произошло в 2011 году.[137]

Машины, обученные глубокому обучению, теперь интерпретируют изображения с камеры на 360 °.[138] Другой пример - анализ лицевой дисморфологии (FDNA), используемый для анализа случаев пороков развития человека, связанных с большой базой данных генетических синдромов.

Обработка визуального искусства

С прогрессом, достигнутым в распознавании изображений, тесно связано все более широкое применение методов глубокого обучения для решения различных задач изобразительного искусства. DNN доказали, что способны, например, а) определять период стиля данной картины, б) Передача нейронного стиля - захват стиля данного произведения искусства и его применение в визуально приятной манере к произвольной фотографии или видео, и в) создание ярких изображений на основе случайных полей визуального ввода.[139][140]

Обработка естественного языка

Нейронные сети используются для реализации языковых моделей с начала 2000-х годов.[109] LSTM помог улучшить машинный перевод и языковое моделирование.[110][111][112]

Другими ключевыми методами в этой области являются отрицательная выборка.[141] и вложение слов. Встраивание слов, например word2vec, можно рассматривать как уровень представления в архитектуре глубокого обучения, который преобразует элементарное слово в позиционное представление слова относительно других слов в наборе данных; позиция представлена точкой в векторное пространство. Использование встраивания слов в качестве входного уровня RNN позволяет сети анализировать предложения и фразы, используя эффективную композиционную векторную грамматику. Композиционную векторную грамматику можно представить как вероятностная контекстно-свободная грамматика (PCFG) реализуется RNN.[142] Рекурсивные автокодировщики, построенные поверх встраивания слов, могут оценивать сходство предложений и обнаруживать перефразирование.[142] Глубокие нейронные архитектуры обеспечивают наилучшие результаты для анализ избирательного округа,[143] анализ настроений,[144] поиск информации,[145][146] понимание разговорной речи,[147] машинный перевод,[110][148] контекстная привязка сущностей,[148] распознавание стиля письма,[149] Классификация текста и другие.[150]

Последние события обобщают вложение слов к вложение предложений.

переводчик Google (GT) использует большой концы с концами сетевая долговременная кратковременная память.[151][152][153][154][155][156] Нейронный машинный перевод Google (GNMT) использует машинный перевод на основе примеров метод, при котором система «учится на миллионах примеров».[152] Он переводит «целые предложения за раз, а не части. Google Translate поддерживает более ста языков».[152] Сеть кодирует «семантику предложения, а не просто запоминание перевода фразы в фразу».[152][157] GT использует английский как промежуточное звено между большинством языковых пар.[157]

Открытие лекарств и токсикология

Большой процент лекарств-кандидатов не получает одобрения регулирующих органов. Эти неудачи вызваны недостаточной эффективностью (целевой эффект), нежелательными взаимодействиями (нецелевые эффекты) или непредвиденными токсические эффекты.[158][159] Исследования изучали использование глубокого обучения для прогнозирования биомолекулярные мишени,[91][92] вне цели, и токсические эффекты химических веществ из окружающей среды в питательных веществах, бытовых товарах и лекарствах.[93][94][95]

AtomNet - это система глубокого обучения для структурных рациональный дизайн лекарств.[160] AtomNet использовалась для предсказания новых биомолекул-кандидатов для целей болезней, таких как Вирус Эбола[161] и рассеянный склероз.[162][163]

В 2019 году генеративные нейронные сети использовались для производства молекул, которые были проверены экспериментально на мышах.[164][165]

Управление взаимоотношениями с клиентами

Глубокое обучение с подкреплением был использован для приближения значения возможных прямой маркетинг действия, определенные в терминах RFM переменные. Было показано, что функция оценочной стоимости имеет естественную интерпретацию как Значение жизни клиентов.[166]

Системы рекомендаций

Системы рекомендаций использовали глубокое обучение для извлечения значимых функций из модели латентных факторов для музыкальных рекомендаций и рекомендаций журналов.[167][168] Глубокое обучение с несколькими представлениями применяется для изучения пользовательских предпочтений из нескольких доменов.[169] Модель использует гибридный подход, основанный на совместной работе и содержании, и расширяет рекомендации при выполнении нескольких задач.

Биоинформатика

An автоэнкодер ИНС использовалась в биоинформатика, предсказывать генная онтология аннотации и отношения гены-функции.[170]

В медицинской информатике для прогнозирования качества сна использовалось глубокое обучение на основе данных с носимых устройств.[171] и прогнозы осложнений со здоровьем от электронная медицинская карта данные.[172]

Анализ медицинских изображений

Доказано, что глубокое обучение дает конкурентные результаты в медицинских приложениях, таких как классификация раковых клеток, обнаружение повреждений, сегментация органов и улучшение изображений.[173][174]

Мобильная реклама

Поиск подходящей мобильной аудитории для мобильная реклама всегда сложно, поскольку необходимо рассмотреть и проанализировать множество точек данных, прежде чем можно будет создать целевой сегмент и использовать его при показе рекламы любым рекламным сервером.[175] Глубокое обучение использовалось для интерпретации больших многомерных наборов рекламных данных. Многие точки данных собираются во время цикла интернет-рекламы запрос / обслуживание / клик. Эта информация может стать основой машинного обучения для улучшения выбора рекламы.

Восстановление изображения

Глубокое обучение успешно применяется к обратные задачи Такие как шумоподавление, сверхвысокое разрешение, рисование, и раскраска пленки.[176] Эти приложения включают методы обучения, такие как «Поля усадки для эффективного восстановления изображения».[177] который тренируется на наборе данных изображения, и Deep Image Prior, который тренируется на изображении, требующем восстановления.

Обнаружение финансового мошенничества

Глубокое обучение успешно применяется в финансовой сфере. Обнаружение мошенничества и борьба с отмыванием денег. «Глубокая система обнаружения отмывания денег может обнаруживать и распознавать взаимосвязи и сходства между данными и, в дальнейшем, научиться обнаруживать аномалии или классифицировать и предсказывать конкретные события». В решении используются как методы обучения с учителем, такие как классификация подозрительных транзакций, так и обучение без учителя, например обнаружение аномалий.[178]

Военный

Министерство обороны США применило глубокое обучение для обучения роботов новым задачам посредством наблюдения.[179]

Отношение к когнитивным функциям и развитию мозга человека

Глубокое обучение тесно связано с классом теорий развитие мозга (в частности, развитие неокортекса), предложенное когнитивные нейробиологи в начале 1990-х гг.[180][181][182][183] Эти теории развития были воплощены в вычислительных моделях, что сделало их предшественниками систем глубокого обучения. Эти модели развития обладают тем же свойством, что различные предлагаемые динамики обучения в мозгу (например, волна фактор роста нервов ) поддерживают самоорганизация в некоторой степени аналогичны нейронным сетям, используемым в моделях глубокого обучения. Словно неокортекс нейронные сети используют иерархию многоуровневых фильтров, в которой каждый уровень рассматривает информацию с предыдущего уровня (или операционной среды), а затем передает свой вывод (и, возможно, исходный ввод) на другие уровни. Этот процесс дает самоорганизующийся стек преобразователи, адаптированные к своей операционной среде. В описании 1995 года говорилось: «... мозг младенца, кажется, организуется под воздействием волн так называемых трофических факторов ... различные области мозга соединяются последовательно, при этом один слой ткани созревает раньше другого, и поэтому до тех пор, пока весь мозг не станет зрелым ".[184]

Для исследования правдоподобности моделей глубокого обучения с нейробиологической точки зрения использовались различные подходы. С одной стороны, несколько вариантов обратное распространение алгоритм был предложен с целью повышения реалистичности его обработки.[185][186] Другие исследователи утверждали, что неконтролируемые формы глубокого обучения, например, основанные на иерархической генеративные модели и сети глубоких убеждений, может быть ближе к биологической реальности.[187][188] В этом отношении модели генеративных нейронных сетей были связаны с нейробиологическими доказательствами обработки данных в коре головного мозга на основе выборки.[189]

Хотя систематическое сравнение между организацией человеческого мозга и кодированием нейронов в глубоких сетях еще не проводилось, было сообщено о нескольких аналогиях. Например, вычисления, выполняемые модулями глубокого обучения, могут быть аналогичны вычислениям реальных нейронов.[190][191] и нейронные популяции.[192] Точно так же представления, разработанные моделями глубокого обучения, аналогичны тем, которые измеряются в зрительной системе приматов.[193] как на одном блоке[194] и у населения[195] уровни.

Коммерческая деятельность

Facebook Лаборатория искусственного интеллекта выполняет такие задачи, как автоматическая пометка загруженных изображений с именами людей в них.[196]

Google DeepMind Technologies разработали систему, способную научиться играть Atari видеоигры, использующие только пиксели в качестве входных данных. В 2015 году они продемонстрировали свои AlphaGo система, которая научилась игре Идти достаточно хорошо, чтобы обыграть профессионального игрока в го.[197][198][199] переводчик Google использует нейронную сеть для перевода между более чем 100 языками.

В 2015 г. Blippar продемонстрировал мобильный дополненная реальность приложение, использующее глубокое обучение для распознавания объектов в реальном времени.[200]

В 2017 году был запущен Covariant.ai, который фокусируется на интеграции глубокого обучения на фабриках.[201]

По состоянию на 2008 г.[202] исследователи в Техасский университет в Остине (UT) разработала структуру машинного обучения под названием «Обучение агента вручную с помощью оценочного подкрепления», или TAMER, в которой были предложены новые методы для роботов или компьютерных программ, позволяющих научиться выполнять задачи, взаимодействуя с человеком-инструктором.[179] Впервые разработанный как TAMER, новый алгоритм под названием Deep TAMER был позже представлен в 2018 году в ходе сотрудничества между Исследовательская лаборатория армии США (ARL) и исследователи UT. Deep TAMER использовал глубокое обучение, чтобы дать роботу возможность изучать новые задачи посредством наблюдения.[179] Используя Deep TAMER, робот изучал задачу с человеком-тренером, просматривая видеопотоки или наблюдая, как человек выполняет задачу лично. Позже робот практиковал задачу с помощью инструктора, который давал такие отзывы, как «хорошая работа» и «плохая работа».[203]

Критика и комментарий

Глубокое обучение привлекает как критику, так и комментарии, в некоторых случаях за пределами области компьютерных наук.

Теория

Основная критика касается отсутствия теории вокруг некоторых методов.[204] Обучение в наиболее распространенных глубоких архитектурах реализовано с использованием хорошо понятного градиентного спуска. Однако теория, связанная с другими алгоритмами, такими как контрастная дивергенция, менее ясна.[нужна цитата ] (например, сходится ли оно? Если да, то как быстро? Что это приблизительно?) Методы глубокого обучения часто рассматриваются как черный ящик, причем большинство подтверждений сделано эмпирически, а не теоретически.[205]

Другие отмечают, что глубокое обучение следует рассматривать как шаг к реализации сильного ИИ, а не как всеобъемлющее решение. Несмотря на мощь методов глубокого обучения, им по-прежнему не хватает многих функций, необходимых для полной реализации этой цели. Психолог-исследователь Гэри Маркус отметил:

«На самом деле глубокое обучение - это лишь часть более сложной задачи создания интеллектуальных машин. Таким методам не хватает способов представления причинно-следственные связи (...) не имеют очевидных способов выполнения логические выводы, и они все еще далеки от интеграции абстрактных знаний, таких как информация о том, что такое объекты, для чего они нужны и как они обычно используются. Самый мощный A.I. системы, такие как Watson (...) использовать такие методы, как глубокое обучение, как лишь один элемент в очень сложном ансамбле методов, начиная от статистического метода Байесовский вывод к дедуктивное мышление."[206]

В качестве дополнительной ссылки на идею о том, что художественная чувствительность может быть присуща относительно низким уровням когнитивной иерархии, опубликованная серия графических представлений внутренних состояний глубоких (20-30 слоев) нейронных сетей, пытающихся различить в по существу случайных данных изображения которым они обучались[207] демонстрируют визуальную привлекательность: первоначальное уведомление об исследовании получило более 1000 комментариев и было темой того, что какое-то время было самой популярной статьей по Хранитель с[208] интернет сайт.

Ошибки

Некоторые архитектуры глубокого обучения демонстрируют проблемное поведение,[209] например, уверенная классификация неузнаваемых изображений как принадлежащих к знакомой категории обычных изображений[210] и неправильная классификация мельчайших искажений правильно классифицированных изображений.[211] Goertzel предположили, что такое поведение связано с ограничениями их внутренних представлений и что эти ограничения будут препятствовать интеграции в гетерогенные многокомпонентные общий искусственный интеллект (AGI) архитектуры.[209] Эти проблемы могут быть решены с помощью архитектур глубокого обучения, которые внутренне формируют состояния, гомологичные грамматике изображений.[212] разложение наблюдаемых сущностей и событий.[209] Изучение грамматики (визуальный или лингвистический) из обучающих данных будет эквивалентно ограничению системы здравый смысл оперирует понятиями с точки зрения грамматики правила производства и является основной целью овладения человеческим языком[213] и искусственный интеллект (AI).[214]

Киберугроза

По мере того как глубокое обучение перемещается из лаборатории в мир, исследования и опыт показывают, что искусственные нейронные сети уязвимы для взломов и обмана.[215] Выявляя шаблоны, которые эти системы используют для работы, злоумышленники могут изменять входные данные для ИНС таким образом, что ИНС находит совпадение, которое не распознаются наблюдателями. Например, злоумышленник может внести незначительные изменения в изображение, чтобы ИНС находила совпадение, даже если изображение не выглядит для человека совсем как цель поиска. Такая манипуляция называется «состязательной атакой».[216] В 2016 году исследователи использовали одну ИНС для проверки изображений методом проб и ошибок, выявления точек соприкосновения с другими и, таким образом, создания изображений, которые вводили их в заблуждение. Измененные изображения не отличались от человеческого глаза. Другая группа показала, что распечатки подделанных изображений, которые затем были сфотографированы, успешно обманули систему классификации изображений.[217] Одним из способов защиты является обратный поиск изображений, при котором возможное поддельное изображение отправляется на такой сайт, как TinEye который затем может найти другие его экземпляры. Уточнение заключается в том, чтобы искать только части изображения, чтобы определить изображения, из которых этот фрагмент мог быть взят..[218]

Другая группа показала, что определенные психоделический очки могут обмануть система распознавания лиц думать, что обычные люди - знаменитости, что потенциально позволяет одному человеку выдавать себя за другого. В 2017 году исследователи добавили стикеры в знаки остановки и вызвал неправильную классификацию ИНС.[217]

Тем не менее, ИНС можно дополнительно обучить обнаруживать попытки обмана, которые потенциально могут привести злоумышленников и защитников к гонке вооружений, подобной той, которая уже определяет вредоносное ПО оборонная промышленность. ИНС были обучены побеждать антивирусное программное обеспечение на основе ИНС путем неоднократных атак на защиту с помощью вредоносного ПО, которое постоянно изменялось генетический алгоритм пока он не обманул антивирус, сохранив при этом способность наносить урон цели.[217]

Другая группа продемонстрировала, что определенные звуки могут вызывать Google сейчас Система голосовых команд открывает определенный веб-адрес, который будет загружать вредоносное ПО.[217]

При «отравлении данных» ложные данные постоянно проникают в обучающий набор системы машинного обучения, чтобы помешать ей достичь мастерства.[217]

Опора на человека микроволновая печь

Большинство систем глубокого обучения полагаются на данные обучения и проверки, которые генерируются и / или аннотируются людьми. Это утверждалось в философия СМИ что не только низкооплачиваемые кликворк (например, на Amazon Mechanical Turk ) регулярно используется для этой цели, но также и неявные формы человеческого микроволновая печь которые часто не признаются таковыми.[219] Философ Райнер Мюльхофф выделяет пять типов «машинного захвата» микропрограммы человека для генерации обучающих данных: (1) игрофикация (встраивание задач аннотации или вычислений в ход игры), (2) «захват и отслеживание» (например, CAPTCHA для распознавания изображений или отслеживания кликов в Google страницы результатов поиска ), (3) эксплуатация социальных мотивов (например, маркировка лиц на Facebook для получения помеченных изображений лиц), (4) добыча информации (например, используя квантифицированный такие устройства, как трекеры активности ) и (5) кликворк.[219] Мюльхофф утверждает, что в большинстве коммерческих приложений глубокого обучения для конечных пользователей, таких как Система распознавания лиц Facebook, потребность в обучающих данных не прекращается после обучения ИНС. Скорее, существует постоянный спрос на данные проверки, созданные человеком, для постоянной калибровки и обновления ИНС. С этой целью Facebook представил функцию, которая, как только пользователь автоматически распознается на изображении, он получает уведомление. Они могут выбрать, хотят ли они, чтобы на изображении были публичные ярлыки, или сказать Facebook, что на картинке нет их.[220] Этот пользовательский интерфейс представляет собой механизм для создания «постоянного потока данных проверки».[219] для дальнейшего обучения сети в режиме реального времени. Как утверждает Мюльхофф, участие пользователей-людей для генерации данных обучения и проверки настолько типично для большинства коммерческих приложений для конечных пользователей Deep Learning, что такие системы можно назвать «искусственным интеллектом, управляемым человеком».[219]

Смотрите также

- Приложения искусственного интеллекта

- Сравнение программного обеспечения для глубокого обучения

- Сжатое зондирование

- Сеть состояния эха

- Список проектов искусственного интеллекта

- Машина жидких состояний

- Список наборов данных для исследования машинного обучения

- Пластовые вычисления

- Разреженное кодирование

Рекомендации

- ^ а б c d е ж Bengio, Y .; Courville, A .; Винсент, П. (2013). «Репрезентативное обучение: обзор и новые перспективы». IEEE Transactions по анализу шаблонов и машинному анализу. 35 (8): 1798–1828. arXiv:1206.5538. Дои:10.1109 / тпами.2013.50. PMID 23787338. S2CID 393948.

- ^ а б c d е ж грамм час Шмидхубер, Дж. (2015). «Глубокое обучение в нейронных сетях: обзор». Нейронные сети. 61: 85–117. arXiv:1404.7828. Дои:10.1016 / j.neunet.2014.09.003. PMID 25462637. S2CID 11715509.

- ^ Бенхио, Йошуа; ЛеКун, Янн; Хинтон, Джеффри (2015). «Глубокое обучение». Природа. 521 (7553): 436–444. Bibcode:2015Натура.521..436L. Дои:10.1038 / природа14539. PMID 26017442. S2CID 3074096.

- ^ а б Ciresan, D .; Meier, U .; Шмидхубер, Дж. (2012). «Многоколоночные глубокие нейронные сети для классификации изображений». Конференция IEEE 2012 года по компьютерному зрению и распознаванию образов. С. 3642–3649. arXiv:1202.2745. Дои:10.1109 / cvpr.2012.6248110. ISBN 978-1-4673-1228-8. S2CID 2161592.

- ^ а б Крижевский, Алексей; Суцкевер Илья; Хинтон, Джеффри (2012). «Классификация ImageNet с глубокими сверточными нейронными сетями» (PDF). NIPS 2012: Системы обработки нейронной информации, Озеро Тахо, Невада.

- ^ «AlphaGo AI от Google выигрывает серию из трех матчей против лучшего в мире игрока в го». TechCrunch. 25 мая 2017.

- ^ Marblestone, Adam H .; Уэйн, Грег; Кординг, Конрад П. (2016). «На пути к интеграции глубокого обучения и нейробиологии». Границы вычислительной нейробиологии. 10: 94. arXiv:1606.03813. Bibcode:2016arXiv160603813M. Дои:10.3389 / fncom.2016.00094. ЧВК 5021692. PMID 27683554. S2CID 1994856.

- ^ Ольсхаузен, Б.А. (1996). «Появление свойств рецептивного поля простых клеток путем изучения разреженного кода для естественных изображений». Природа. 381 (6583): 607–609. Bibcode:1996Натура.381..607O. Дои:10.1038 / 381607a0. PMID 8637596. S2CID 4358477.

- ^ Бенхио, Йошуа; Ли, Дон Хён; Bornschein, Jorg; Меснард, Томас; Линь, Чжухань (13.02.2015). «К биологически правдоподобному глубокому обучению». arXiv:1502.04156 [cs.LG ].

- ^ Шульц, Ханнес; Бенке, Свен (01.11.2012). «Глубокое обучение». KI - Künstliche Intelligenz. 26 (4): 357–363. Дои:10.1007 / s13218-012-0198-z. ISSN 1610-1987. S2CID 220523562.

- ^ а б c d е ж Deng, L .; Ю. Д. (2014). «Глубокое обучение: методы и приложения» (PDF). Основы и тенденции в обработке сигналов. 7 (3–4): 1–199. Дои:10.1561/2000000039.

- ^ а б c d е Бенхио, Йошуа (2009). «Изучение глубинных архитектур для ИИ» (PDF). Основы и тенденции в машинном обучении. 2 (1): 1–127. CiteSeerX 10.1.1.701.9550. Дои:10.1561/2200000006. Архивировано из оригинал (PDF) на 2016-03-04. Получено 2015-09-03.

- ^ ЛеКун, Янн; Бенхио, Йошуа; Хинтон, Джеффри (28 мая 2015 г.). «Глубокое обучение». Природа. 521 (7553): 436–444. Bibcode:2015Натура.521..436L. Дои:10.1038 / природа14539. PMID 26017442. S2CID 3074096.

- ^ Сигеки, Сугияма (12 апреля 2019 г.). Человеческое поведение и другой вид сознания: новые исследования и возможности: новые исследования и возможности. IGI Global. ISBN 978-1-5225-8218-2.

- ^ Бенхио, Йошуа; Ламблин, Паскаль; Поповичи, Дан; Ларошель, Хьюго (2007). Жадное послойное обучение глубоких сетей (PDF). Достижения в области нейронных систем обработки информации. С. 153–160.

- ^ а б Шмидхубер, Юрген (2015). «Глубокое обучение». Scholarpedia. 10 (11): 32832. Bibcode:2015SchpJ..1032832S. Дои:10.4249 / scholarpedia.32832.

- ^ а б c Хинтон, Г. (2009). "Сети глубоких убеждений". Scholarpedia. 4 (5): 5947. Bibcode:2009SchpJ ... 4.5947H. Дои:10.4249 / scholarpedia.5947.

- ^ а б c Цибенко (1989). «Аппроксимации суперпозициями сигмоидальных функций» (PDF). Математика управления, сигналов и систем. 2 (4): 303–314. Дои:10.1007 / bf02551274. S2CID 3958369. Архивировано из оригинал (PDF) на 2015-10-10.

- ^ а б c Хорник, Курт (1991). «Возможности аппроксимации многослойных сетей прямого распространения». Нейронные сети. 4 (2): 251–257. Дои:10.1016 / 0893-6080 (91) 90009-т.

- ^ а б Хайкин, Саймон С. (1999). Нейронные сети: всеобъемлющий фундамент. Прентис Холл. ISBN 978-0-13-273350-2.

- ^ а б Хассун, Мохамад Х. (1995). Основы искусственных нейронных сетей. MIT Press. п. 48. ISBN 978-0-262-08239-6.

- ^ а б Лу, З., Пу, Х., Ван, Ф., Ху, З., и Ван, Л. (2017). Выразительная сила нейронных сетей: взгляд из глубины. Системы обработки нейронной информации, 6231-6239.

- ^ а б c d Мерфи, Кевин П. (24 августа 2012 г.). Машинное обучение: вероятностная перспектива. MIT Press. ISBN 978-0-262-01802-9.

- ^ Сонода, Шо; Мурата, Нобору (2017). «Нейронная сеть с неограниченными функциями активации - универсальный аппроксиматор». Прикладной и вычислительный гармонический анализ. 43 (2): 233–268. arXiv:1505.03654. Дои:10.1016 / j.acha.2015.12.005. S2CID 12149203.

- ^ Hinton, G.E .; Srivastava, N .; Крижевский, А .; Суцкевер, И .; Салахутдинов, Р.Р. (2012). «Улучшение нейронных сетей путем предотвращения совместной адаптации детекторов функций». arXiv:1207.0580 [math.LG ].

- ^ Епископ, Кристофер М. (2006). Распознавание образов и машинное обучение (PDF). Springer. ISBN 978-0-387-31073-2.

- ^ Ивахненко, А.Г .; Лапа, В. Г. (1967). Кибернетика и методы прогнозирования. American Elsevier Publishing Co. ISBN 978-0-444-00020-0.

- ^ а б Ивахненко, Алексей (1971). «Полиномиальная теория сложных систем» (PDF). IEEE Transactions по системам, человеку и кибернетике. СМЦ-1 (4): 364–378. Дои:10.1109 / TSMC.1971.4308320.

- ^ Фукусима, К. (1980). «Неокогнитрон: модель самоорганизующейся нейронной сети для механизма распознавания образов, не зависящего от изменения положения». Биол. Cybern. 36 (4): 193–202. Дои:10.1007 / bf00344251. PMID 7370364. S2CID 206775608.

- ^ Рина Дечтер (1986). Обучение в поисках проблем удовлетворения ограничений. Калифорнийский университет, факультет компьютерных наук, лаборатория когнитивных систем.В сети

- ^ Игорь Айзенберг, Наум Н. Айзенберг, Джоос П.Л. Вандевалле (2000). Многозначные и универсальные бинарные нейроны: теория, обучение и приложения. Springer Science & Business Media.

- ^ Совместно развивающиеся рекуррентные нейроны изучают POMDP глубокой памяти. Proc. GECCO, Вашингтон, округ Колумбия, стр. 1795-1802, ACM Press, Нью-Йорк, Нью-Йорк, США, 2005.

- ^ Сеппо Линнаинмаа (1970). Представление совокупной ошибки округления алгоритма в виде разложения Тейлора локальных ошибок округления. Магистерская работа (на финском языке), Univ. Хельсинки, 6-7.

- ^ Гриванк, Андреас (2012). «Кто изобрел обратный способ дифференциации?» (PDF). Documenta Mathematica (Дополнительный том ISMP): 389–400. Архивировано из оригинал (PDF) на 2017-07-21. Получено 2017-06-11.

- ^ Вербос П. (1974). «За пределами регрессии: новые инструменты для прогнозирования и анализа в поведенческих науках». Гарвардский университет. Получено 12 июн 2017.

- ^ Вербос, Пол (1982). «Применение достижений в нелинейном анализе чувствительности» (PDF). Системное моделирование и оптимизация. Springer. С. 762–770.

- ^ а б LeCun и другие., «Обратное распространение, применяемое для распознавания рукописного почтового индекса», Нейронные вычисления1. С. 541–551, 1989.

- ^ Дж. Венг, Н. Ахуджа и Т. С. Хуанг "Крецептрон: самоорганизующаяся нейронная сеть, которая адаптивно растет," Proc. Международная совместная конференция по нейронным сетям, Балтимор, Мэриленд, том I, стр. 576-581, июнь 1992 г.

- ^ Дж. Венг, Н. Ахуджа и Т. С. Хуанг "Обучение распознаванию и сегментации трехмерных объектов из двухмерных изображений," Proc. 4-я Международная конф. Компьютерное зрение, Берлин, Германия, стр. 121-128, май 1993 г.

- ^ Дж. Венг, Н. Ахуджа и Т. С. Хуанг "Распознавание и сегментация обучения с помощью Cresceptron," Международный журнал компьютерного зрения, т. 25, нет. 2, стр. 105-139, ноябрь 1997 г.

- ^ де Карвалью, Андре К. Л. Ф .; Fairhurst, Mike C .; Биссет, Дэвид (1994-08-08). «Интегрированная логическая нейронная сеть для классификации образов». Письма с распознаванием образов. 15 (8): 807–813. Дои:10.1016/0167-8655(94)90009-4.

- ^ Хинтон, Джеффри Э .; Даян, Питер; Фрей, Брендан Дж .; Нил, Рэдфорд (1995-05-26). «Алгоритм бодрствования-сна для неконтролируемых нейронных сетей». Наука. 268 (5214): 1158–1161. Bibcode:1995Научный ... 268.1158H. Дои:10.1126 / science.7761831. PMID 7761831.

- ^ а б С. Хохрайтер. "Untersuchungen zu Dynamischen Neuronalen Netzen," Дипломная работа. Institut f. Informatik, Technische Univ. Мюнхен. Советник: Я. Шмидхубер, 1991.

- ^ Hochreiter, S .; и другие. (15 января 2001 г.). «Градиентный поток в повторяющихся сетях: трудность изучения долгосрочных зависимостей». В Колене, Джон Ф .; Кремер, Стефан С. (ред.). Полевое руководство по динамическим рекуррентным сетям. Джон Вили и сыновья. ISBN 978-0-7803-5369-5.

- ^ Бенке, Свен (2003). «Иерархические нейронные сети для интерпретации изображений». Конспект лекций по информатике. Дои:10.1007 / b11963. ISSN 0302-9743.

- ^ Морган, Нельсон; Бурлар, Эрве; Renals, Стив; Коэн, Майкл; Франко, Орасио (1993-08-01). «Гибридные нейронные сети / системы скрытых марковских моделей для распознавания слитной речи». Международный журнал распознавания образов и искусственного интеллекта. 07 (4): 899–916. Дои:10.1142 / s0218001493000455. ISSN 0218-0014.

- ^ Робинсон, Т. (1992). «Система распознавания слов сети распространения повторяющихся ошибок в реальном времени». ICASSP. Icassp'92: 617–620. ISBN 9780780305328.

- ^ Waibel, A .; Hanazawa, T .; Hinton, G .; Shikano, K .; Ланг, К. Дж. (Март 1989 г.). «Распознавание фонем с помощью нейронных сетей с запаздыванием» (PDF). Транзакции IEEE по акустике, речи и обработке сигналов. 37 (3): 328–339. Дои:10.1109/29.21701. HDL:10338.dmlcz / 135496. ISSN 0096-3518.

- ^ Baker, J .; Дэн Ли; Гласс, Джим; Худанпур, С .; Lee, C.-H .; Morgan, N .; О'Шонесси, Д. (2009). «Исследования и направления в распознавании и понимании речи, часть 1». Журнал IEEE Signal Processing Magazine. 26 (3): 75–80. Bibcode:2009ISPM ... 26 ... 75B. Дои:10.1109 / msp.2009.932166. S2CID 357467.

- ^ Бенджио Ю. (1991). «Искусственные нейронные сети и их применение для распознавания речи / последовательностей». Университет Макгилла, доктор философии. Тезис.

- ^ Deng, L .; Hassanein, K .; Элмасри, М. (1994). «Анализ корреляционной структуры для нейронной предсказательной модели с приложениями к распознаванию речи». Нейронные сети. 7 (2): 331–339. Дои:10.1016/0893-6080(94)90027-2.

- ^ Doddington, G .; Przybocki, M .; Мартин, А .; Рейнольдс, Д. (2000). «Оценка узнаваемости спикеров NIST - Обзор, методология, системы, результаты, перспективы». Речевое общение. 31 (2): 225–254. Дои:10.1016 / S0167-6393 (99) 00080-1.

- ^ а б Heck, L .; Konig, Y .; Sonmez, M .; Вайнтрауб М. (2000). «Устойчивость к искажению телефонных трубок в распознавании говорящих за счет дискриминационного дизайна». Речевое общение. 31 (2): 181–192. Дои:10.1016 / s0167-6393 (99) 00077-1.

- ^ «Акустическое моделирование с помощью глубоких нейронных сетей с использованием необработанного сигнала времени для LVCSR (доступна загрузка PDF-файла)». ResearchGate. Получено 2017-06-14.

- ^ а б c Хохрайтер, Зепп; Шмидхубер, Юрген (1 ноября 1997 г.). «Кратковременная долговременная память». Нейронные вычисления. 9 (8): 1735–1780. Дои:10.1162 / neco.1997.9.8.1735. ISSN 0899-7667. PMID 9377276. S2CID 1915014.

- ^ а б Грейвс, Алекс; Эк, Дуглас; Берингер, Николь; Шмидхубер, Юрген (2003). «Биологически правдоподобное распознавание речи с помощью нейронных сетей LSTM» (PDF). 1st Intl. Семинар по биологически вдохновленным подходам к передовым информационным технологиям, Bio-ADIT 2004, Лозанна, Швейцария. С. 175–184.

- ^ а б Грейвс, Алекс; Фернандес, Сантьяго; Гомес, Фаустино (2006). «Временная классификация коннекционистов: маркировка несегментированных данных последовательности с помощью рекуррентных нейронных сетей». Труды Международной конференции по машинному обучению, ICML 2006: 369–376. CiteSeerX 10.1.1.75.6306.

- ^ Сантьяго Фернандес, Алекс Грейвс и Юрген Шмидхубер (2007). Применение рекуррентных нейронных сетей для распознавания ключевых слов. Протоколы ICANN (2), стр. 220–229.

- ^ а б Сак, Хашим; Старший, Андрей; Рао, Канишка; Бофейс, Франсуаза; Шалквик, Йохан (сентябрь 2015 г.). «Голосовой поиск Google: быстрее и точнее».

- ^ Хинтон, Джеффри Э. (2007-10-01). «Изучение нескольких уровней представления». Тенденции в когнитивных науках. 11 (10): 428–434. Дои:10.1016 / j.tics.2007.09.004. ISSN 1364-6613. PMID 17921042. S2CID 15066318.

- ^ Хинтон, Г.Э.; Осиндеро, С .; Тех, Ю. В. (2006). "Алгоритм быстрого обучения для сетей глубокого убеждения" (PDF). Нейронные вычисления. 18 (7): 1527–1554. Дои:10.1162 / neco.2006.18.7.1527. PMID 16764513. S2CID 2309950.

- ^ Бенхио, Йошуа (2012). «Практические рекомендации по градиентному обучению глубоких архитектур». arXiv:1206.5533 [cs.LG ].

- ^ Г. Э. Хинтон. "Изучение нескольких уровней представления," Тенденции в когнитивных науках2007. Т. 11. С. 428–434.

- ^ а б c Hinton, G .; Deng, L .; Ю, Д .; Dahl, G .; Мохамед, А .; Jaitly, N .; Старший, А .; Vanhoucke, V .; Nguyen, P .; Sainath, T .; Кингсбери, Б. (2012). «Глубокие нейронные сети для акустического моделирования в распознавании речи: общие взгляды четырех исследовательских групп». Журнал IEEE Signal Processing Magazine. 29 (6): 82–97. Bibcode:2012ISPM ... 29 ... 82H. Дои:10.1109 / msp.2012.2205597. S2CID 206485943.

- ^ Дэн Ли; Хинтон, Джеффри; Кингсбери, Брайан (1 мая 2013 г.). «Новые типы глубокого обучения нейронной сети для распознавания речи и связанных приложений: обзор». Microsoft Research. CiteSeerX 10.1.1.368.1123 - через research.microsoft.com.

- ^ Дэн Ли; Ли, Цзиньюй; Хуанг, Цзюй-Тин; Яо, Кайшэн; Ю, Донг; Сейде, Фрэнк; Зельцер, Майкл; Цвейг, Джефф; Он, Сяодун; Уильямс, Джейсон; Гун, Ифань; Асеро, Алекс (2013). «Последние достижения в области глубокого обучения для исследования речи в Microsoft». Международная конференция IEEE по акустике, обработке речи и сигналов, 2013 г.. С. 8604–8608. Дои:10.1109 / icassp.2013.6639345. ISBN 978-1-4799-0356-6. S2CID 13412186.

- ^ Сак, хасим; Старший, Андрей; Бофэ, Франсуаза (2014). «Рекуррентные архитектуры нейронных сетей с кратковременной памятью для крупномасштабного акустического моделирования» (PDF). Архивировано из оригинал (PDF) на 2018-04-24.

- ^ Ли, Сянган; У, Xihong (2014). «Построение глубоких рекуррентных нейронных сетей на основе кратковременной памяти для распознавания речи с большим словарным запасом». arXiv:1410.4281 [cs.CL ].

- ^ Дзен, Хейга; Сак, Хасим (2015). «Однонаправленная рекуррентная нейронная сеть с долговременной краткосрочной памятью и рекуррентным выходным уровнем для синтеза речи с малой задержкой» (PDF). Google.com. ICASSP. С. 4470–4474.

- ^ Deng, L .; Abdel-Hamid, O .; Ю. Д. (2013). «Глубокая сверточная нейронная сеть, использующая гетерогенный пул для обмена акустической инвариантностью с фонетической путаницей» (PDF). Google.com. ICASSP.

- ^ а б Sainath, Tara N .; Мохамед, Абдель-Рахман; Кингсбери, Брайан; Рамабхадран, Бхувана (2013). «Глубокие сверточные нейронные сети для LVCSR». Международная конференция IEEE по акустике, обработке речи и сигналов, 2013 г.. С. 8614–8618. Дои:10.1109 / icassp.2013.6639347. ISBN 978-1-4799-0356-6. S2CID 13816461.

- ^ Янн ЛеКун (2016). Слайды по глубокому обучению В сети

- ^ а б c Семинар NIPS: Глубокое обучение для распознавания речи и связанных приложений, Уистлер, Британская Колумбия, Канада, декабрь 2009 г. (Организаторы: Ли Дэн, Джефф Хинтон, Д. Ю).

- ^ а б Основной доклад: Последние разработки в глубоких нейронных сетях. ICASSP, 2013 (Джефф Хинтон).

- ^ Д. Ю, Л. Дэн, Г. Ли и Ф. Сейде (2011). «Дискриминационное предварительное обучение глубоких нейронных сетей», патентная заявка США.

- ^ а б c Deng, L .; Hinton, G .; Кингсбери, Б. (2013). «Новые типы глубокого обучения нейронной сети для распознавания речи и связанных приложений: обзор (ICASSP)» (PDF). Цитировать журнал требует

| журнал =(помощь) - ^ а б c Ю, Д .; Дэн, Л. (2014). Автоматическое распознавание речи: подход глубокого обучения (Издатель: Springer). ISBN 978-1-4471-5779-3.

- ^ «Дэн получает престижную награду IEEE Technical Achievement Award - Microsoft Research». Microsoft Research. 3 декабря 2015.

- ^ а б Ли, Дэн (сентябрь 2014 г.). Основной доклад: «Достижения и проблемы глубокого обучения - от анализа и распознавания речи до языка и мультимодальной обработки»'". Межречевой.

- ^ Ю, Д .; Дэн, Л. (2010). «Роли предварительного обучения и тонкой настройки в контекстно-зависимых DBN-HMM для распознавания речи в реальном мире». Семинар NIPS по глубокому обучению и неконтролируемому обучению функций.

- ^ Seide, F .; Li, G .; Ю. Д. (2011). «Транскрипция разговорной речи с использованием контекстно-зависимых глубоких нейронных сетей». Межречевой.

- ^ Дэн Ли; Ли, Цзиньюй; Хуанг, Цзюй-Тин; Яо, Кайшэн; Ю, Донг; Сейде, Фрэнк; Зельцер, Майк; Цвейг, Джефф; Он, Сяодун (01.05.2013). «Последние достижения в области глубокого обучения для исследования речи в Microsoft». Microsoft Research.

- ^ «Генеральный директор Nvidia делает большую ставку на глубокое обучение и виртуальную реальность». Венчурный бит. 5 апреля 2016 г.

- ^ «От неработающего к нейросетям». Экономист.

- ^ а б О, К.-С .; Юнг, К. (2004). «Реализация нейронных сетей на GPU». Распознавание образов. 37 (6): 1311–1314. Дои:10.1016 / j.patcog.2004.01.013.

- ^ "Обзор методов оптимизации глубокого обучения на графических процессорах ", С. Миттал и С. Вайшай, Журнал системной архитектуры, 2019 г.

- ^ а б Челлапилла, К., Пури, С., и Симард, П. (2006). Высокопроизводительные сверточные нейронные сети для обработки документов. Международный семинар по вопросам распознавания почерка.

- ^ Чирешан, Дэн Клаудиу; Мейер, Ули; Гамбарделла, Лука Мария; Шмидхубер, Юрген (21 сентября 2010 г.). «Глубокие, большие, простые нейронные сети для распознавания рукописных цифр». Нейронные вычисления. 22 (12): 3207–3220. arXiv:1003.0358. Дои:10.1162 / neco_a_00052. ISSN 0899-7667. PMID 20858131. S2CID 1918673.

- ^ Райна, Раджат; Мадхаван, Ананд; Нг, Эндрю Ю. (2009). «Крупномасштабное глубокое обучение без учителя с использованием графических процессоров». Материалы 26-й ежегодной международной конференции по машинному обучению. ICML '09. Нью-Йорк, Нью-Йорк, США: ACM: 873–880. CiteSeerX 10.1.1.154.372. Дои:10.1145/1553374.1553486. ISBN 9781605585161. S2CID 392458.

- ^ Зе, Вивьен; Чен Ю-Синь; Ян, Тянь-Цзюй; Эмер, Джоэл (2017). «Эффективная обработка глубоких нейронных сетей: учебное пособие и обзор». arXiv:1703.09039 [cs.CV ].

- ^ а б «Проблема молекулярной активности Merck». kaggle.com.

- ^ а б "Многозадачные нейронные сети для прогнозирования QSAR | Data Science Association". www.datascienceassn.org. Получено 2017-06-14.

- ^ а б «Токсикология в вызове данных 21 века»

- ^ а б «NCATS объявляет победителей конкурса данных Tox21».

- ^ а б «Архивная копия». Архивировано из оригинал на 2015-02-28. Получено 2015-03-05.CS1 maint: заархивированная копия как заголовок (связь)

- ^ Ciresan, D.C .; Meier, U .; Masci, J .; Gambardella, L.M .; Шмидхубер, Дж. (2011). «Гибкие, высокопроизводительные сверточные нейронные сети для классификации изображений» (PDF). Международная совместная конференция по искусственному интеллекту. Дои:10.5591 / 978-1-57735-516-8 / ijcai11-210.

- ^ Чиресан, Дан; Джусти, Алессандро; Gambardella, Luca M .; Шмидхубер, Юрген (2012). Pereira, F .; Burges, C.J.C .; Bottou, L .; Weinberger, K. Q. (ред.). Достижения в системах обработки нейронной информации 25 (PDF). Curran Associates, Inc., стр. 2843–2851.

- ^ Ciresan, D .; Giusti, A .; Gambardella, L.M .; Шмидхубер, Дж. (2013). «Обнаружение митоза в изображениях гистологии рака молочной железы с использованием глубоких нейронных сетей». Труды MICCAI. Конспект лекций по информатике. 7908 (Pt 2): 411–418. Дои:10.1007/978-3-642-40763-5_51. ISBN 978-3-642-38708-1. PMID 24579167.

- ^ «Проект идентификации изображений на языке Wolfram Language». www.imageidentify.com. Получено 2017-03-22.

- ^ Виньялс, Ориол; Тошев Александр; Бенджио, Сами; Эрхан, Думитру (2014). «Покажи и расскажи: генератор заголовков нейронных изображений». arXiv:1411.4555 [cs.CV ]..

- ^ Фанг, Хао; Гупта, Саураб; Иандола, Форрест; Шривастава, Рупеш; Дэн Ли; Dollár, Петр; Гао, Цзяньфэн; Он, Сяодун; Митчелл, Маргарет; Платт, Джон С; Лоуренс Зитник, C; Цвейг, Джеффри (2014). «От подписей к наглядным представлениям и обратно». arXiv:1411.4952 [cs.CV ]..

- ^ Кирос, Райан; Салахутдинов Руслан; Земель, Ричард S (2014). «Объединение визуально-семантических вложений с многомодальными моделями нейронного языка». arXiv:1411.2539 [cs.LG ]..

- ^ Чжун, Шэн-хуа; Лю, Ян; Лю, Ян (2011). «Билинейное глубокое обучение для классификации изображений». Материалы 19-й Международной конференции ACM по мультимедиа. ММ '11. Нью-Йорк, Нью-Йорк, США: ACM: 343–352. Дои:10.1145/2072298.2072344. HDL:10397/23574. ISBN 9781450306164. S2CID 11922007.

- ^ «Почему глубокое обучение внезапно меняет вашу жизнь». Удача. 2016. Получено 13 апреля 2018.

- ^ Сильвер, Дэвид; Хуанг, Аджа; Мэддисон, Крис Дж .; Гез, Артур; Сифре, Лоран; Дрише, Джордж ван ден; Шриттвизер, Джулиан; Антоноглоу, Иоаннис; Паннеершелвам, Веда (январь 2016 г.). «Освоение игры го с глубокими нейронными сетями и поиском по дереву». Природа. 529 (7587): 484–489. Bibcode:2016Натура.529..484S. Дои:10.1038 / природа16961. ISSN 1476-4687. PMID 26819042. S2CID 515925.

- ^ Руководство по глубокому обучению и нейронным сетям

- ^ Сегеди, Кристиан; Тошев Александр; Эрхан, Думитру (2013). «Глубокие нейронные сети для обнаружения объектов». Достижения в системах обработки нейронной информации: 2553–2561.

- ^ Хоф, Роберт Д. «Искусственный интеллект наконец-то вступает в свои права?». Обзор технологий MIT. Получено 2018-07-10.

- ^ а б Gers, Felix A .; Шмидхубер, Юрген (2001). «Рекуррентные сети LSTM изучают простые контекстно-свободные и контекстно-зависимые языки». IEEE-транзакции в нейронных сетях. 12 (6): 1333–1340. Дои:10.1109/72.963769. PMID 18249962.

- ^ а б c Суцкевер, Л .; Vinyals, O .; Ле, К. (2014). «Последовательность для последовательного обучения с помощью нейронных сетей» (PDF). Proc. НИПС. arXiv:1409.3215. Bibcode:2014arXiv1409.3215S.

- ^ а б Юзефович, Рафаль; Виньялс, Ориол; Шустер, Майк; Шазир, Ноам; Ву, Юнхуэй (2016). «Изучение границ языкового моделирования». arXiv:1602.02410 [cs.CL ].

- ^ а б Гиллик, Дэн; Бранк, Клифф; Виньялс, Ориол; Субраманья, Амарнаг (2015). «Многоязычная обработка байтов». arXiv:1512.00103 [cs.CL ].

- ^ Миколов, Т .; и другие. (2010). «Языковая модель на основе рекуррентной нейронной сети» (PDF). Межречевой.

- ^ а б «Изучение точного времени с помощью рекуррентных сетей LSTM (доступна загрузка PDF-файла)». ResearchGate. Получено 2017-06-13.

- ^ LeCun, Y .; и другие. (1998). «Градиентное обучение применительно к распознаванию документов». Труды IEEE. 86 (11): 2278–2324. Дои:10.1109/5.726791.

- ^ Бенхио, Йошуа; Буланже-Левандовски, Николас; Паскану, Разван (2013). «Достижения в оптимизации рекуррентных сетей». Международная конференция IEEE по акустике, обработке речи и сигналов, 2013 г.. С. 8624–8628. arXiv:1212.0901. CiteSeerX 10.1.1.752.9151. Дои:10.1109 / icassp.2013.6639349. ISBN 978-1-4799-0356-6. S2CID 12485056.

- ^ Dahl, G .; и другие. (2013). «Улучшение DNN для LVCSR с использованием выпрямленных линейных единиц и отсева» (PDF). ICASSP.

- ^ «Расширение данных - deeplearning.ai | Coursera». Coursera. Получено 2017-11-30.

- ^ Хинтон, Г. Э. (2010). «Практическое руководство по обучению ограниченных машин Больцмана». Tech. Представитель UTML TR 2010-003.

- ^ Ты, Ян; Булуч, Айдын; Деммел, Джеймс (ноябрь 2017 г.). «Масштабирование глубокого обучения на GPU и кластерах высадки рыцарей». Труды Международной конференции по высокопроизводительным вычислениям, сетям, хранению данных и анализу на - SC '17. SC '17, ACM. С. 1–12. Дои:10.1145/3126908.3126912. ISBN 9781450351140. S2CID 8869270. Получено 5 марта 2018.

- ^ Вибке, Андре; Мемети, Суэйб; Пллана, Сабри; Авраам, Аджит (2019). «CHAOS: схема распараллеливания для обучения сверточных нейронных сетей на Intel Xeon Phi». Журнал суперкомпьютеров. 75: 197–227. arXiv:1702.07908. Bibcode:2017arXiv170207908V. Дои:10.1007 / s11227-017-1994-х. S2CID 14135321.

- ^ Тинг Цинь и др. «Алгоритм обучения CMAC на основе RLS». Письма о нейронной обработке 19.1 (2004): 49-61.

- ^ Тинг Цинь и др. "Непрерывный CMAC-QRLS и его систолический массив. "Письма о нейронной обработке 22.1 (2005): 1-16.

- ^ Research, AI (23 октября 2015 г.). «Глубокие нейронные сети для акустического моделирования в распознавании речи». airesearch.com. Получено 23 октября 2015.

- ^ «Графические процессоры продолжают доминировать на рынке ускорителей искусственного интеллекта». Информационная неделя. Декабрь 2019 г.. Получено 11 июн 2020.

- ^ Рэй, Тирнан (2019). «ИИ меняет всю природу вычислений». ZDNet. Получено 11 июн 2020.

- ^ «ИИ и вычисления». OpenAI. 16 мая 2018. Получено 11 июн 2020.

- ^ Корпус акустико-фонетической непрерывной речи TIMIT Консорциум лингвистических данных, Филадельфия.

- ^ Робинсон, Тони (30 сентября 1991 г.). «Несколько улучшений системы распознавания телефона в сети с повторяющимся распространением ошибок». Технический отчет инженерного факультета Кембриджского университета. CUED / F-INFENG / TR82. Дои:10.13140 / RG.2.2.15418.90567.

- ^ Abdel-Hamid, O .; и другие. (2014). «Сверточные нейронные сети для распознавания речи». Транзакции IEEE / ACM для обработки звука, речи и языка. 22 (10): 1533–1545. Дои:10.1109 / taslp.2014.2339736. S2CID 206602362.

- ^ Deng, L .; Платт Дж. (2014). «Ансамбль глубокого обучения для распознавания речи». Proc. Межречевой. S2CID 15641618.

- ^ Тот, Ласло (2015). «Распознавание телефонов с помощью иерархических сверточных сетей Deep Maxout» (PDF). Журнал EURASIP по обработке звука, речи и музыки. 2015. Дои:10.1186 / s13636-015-0068-3. S2CID 217950236.

- ^ Макмиллан, Роберт (2014-12-17). «Как Skype использовал AI для создания своего удивительного переводчика нового языка | WIRED». Проводной. Получено 2017-06-14.

- ^ Ханнун, Авни; Кейс, Карл; Каспер, Джаред; Катандзаро, Брайан; Диамос, Грег; Эльзен, Эрих; Пренгер, Райан; Сатиш, Санджив; Сенгупта, Шубхо; Коутс, Адам; Нг, Эндрю Y (2014). «Глубокая речь: масштабирование сквозного распознавания речи». arXiv:1412.5567 [cs.CL ].