История искусственного интеллекта - History of artificial intelligence

| Часть серии по |

| Искусственный интеллект |

|---|

Технологии |

Глоссарий |

| История вычислительной техники |

|---|

| Оборудование |

| Программного обеспечения |

| Информатика |

| Современные концепции |

| По стране |

| Хронология вычислений |

| Глоссарий информатики |

|

В история искусственного интеллекта (AI) началось в древность, с мифами, историями и слухами об искусственных существах, наделенных умом или сознанием мастерами. Семена современного ИИ были посеяны классическими философами, которые пытались описать процесс человеческого мышления как механическое манипулирование символами. Эта работа завершилась изобретением программируемый цифровой компьютер в 1940-х машина, основанная на абстрактной сущности математических рассуждений. Это устройство и лежащие в его основе идеи вдохновили группу ученых на серьезное обсуждение возможности создания электронного мозга.

Поле AI исследование было основано в цех проводится в кампусе Дартмутский колледж летом 1956 г.[1] Те, кто посетят, станут лидерами исследований ИИ на десятилетия. Многие из них предсказывали, что такая умная машина, как человек, будет существовать не более чем через поколение, и им дали миллионы долларов, чтобы воплотить это видение в жизнь.

В конце концов стало очевидно, что они сильно недооценили сложность проекта. В 1973 году в ответ на критику со стороны Джеймс Лайтхилл и постоянное давление со стороны Конгресса, НАС. и Британские правительства прекратил финансирование неориентированных исследований в области искусственного интеллекта, и последующие трудные годы позже будут известны как "AI зима ". Семь лет спустя дальновидная инициатива Правительство Японии вдохновили правительства и промышленность на предоставление ИИ миллиардов долларов, но к концу 80-х инвесторы разочаровались и снова отозвали финансирование.

Инвестиции и интерес к ИИ резко возросли в первые десятилетия 21 века, когда машинное обучение был успешно применен для решения многих проблем в научных кругах и промышленности благодаря новым методам, применению мощного компьютерного оборудования и сбору огромных наборов данных.

Прекурсоры

Мифические, вымышленные и умозрительные предшественники

Миф и легенда

В греческой мифологии Талос был гигант, построенный из бронзы, который действовал как страж острова Крит. Он бросал валуны в корабли захватчиков и ежедневно совершал 3 круга по периметру острова.[2] Согласно с псевдоаполлодор ' Bibliotheke, Гефест кованый Талос с помощью циклопа и преподнесла автомат в подарок Минос.[3] в Аргонавтика, Джейсон и аргонавты победили его с помощью единственной пробки возле его ноги, которая, будучи удалена, позволяла жизненно важной ихор вытекать из его тела и оставлять его неодушевленным.[4]

Пигмалион был легендарным королем и скульптором греческой мифологии, широко представленным в Овидия Метаморфозы. В 10-й книге повествовательной поэмы Овидия Пигмалион испытывает отвращение к женщинам, когда видит, как Пропоэтиды проститутки себя.[5] Несмотря на это, он делает подношения в храме Венеры, прося богиню принести ему женщину, похожую на статую, которую он вырезал и в которую влюбился. Действительно статуя, Галатея, ожила и, по некоторым сведениям, они с Пигмалионом зачали ребенка.[6]

В Голем это искусственное существо еврейского фольклора, созданное из глины и, в зависимости от источника, часто ставшее целью. Самый ранний письменный отчет о создании големов находится в трудах Елеазар бен Иуда из Вормса около 12-13 вв.[7] В средние века считалось, что анимация Голем Это можно сделать, вставив лист бумаги с любым из имен Бога в рот глиняной фигурки.[8] В отличие от легендарных автоматов вроде Медные головы, а Голем не мог говорить.[9]

Алхимические средства искусственного интеллекта

В О природе вещей, написанная алхимиком швейцарского происхождения, Парацельс, он описывает процедуру, с помощью которой, как он утверждает, можно сфабриковать «искусственного человека». Поместив «сперму человека» в конский навоз и скармливая ее «Арканом крови человека» через 40 дней, смесь превратится в живого младенца.[10] Предшествующий Парацельсу был Джабир ибн Хайян Взглянем на гомункула: Таквин[11] В Фауст, Вторая часть трагедии от Иоганн Вольфганг фон Гете алхимически созданный гомункул, которому суждено жить вечно в колбе, в которой он был сделан, стремится родиться в полноценном человеческом теле. Однако после начала этой трансформации колба разбивается, и гомункул умирает.[12]

Ранние современные легендарные автоматы

Говорят, что в период раннего Нового времени эти легендарные автоматы обладали магической способностью отвечать на задаваемые им вопросы. Предполагалось, что позднесредневековый алхимик и ученый Роджер Бэкон сфабриковал наглая голова, разработав легенду о том, что был волшебником.[13] Эти легенды были похожи на скандинавский миф о Голове Мимира. Согласно легенде, Мимир был известен своим интеллектом и мудростью и был обезглавлен во время айсирско-ванирской войны. Говорят, Один «забальзамировал» голову травами и произносил над ней заклинания, так что голова Мимира оставалась способной говорить мудрость Одину. Затем Один держал голову возле себя для совета.[14]

Современная фантастика

К 19 веку идеи об искусственных людях и мыслящих машинах получили развитие в художественной литературе, например Мэри Шелли с Франкенштейн или Карел Чапек с R.U.R. (Универсальные роботы Россум),[15]и предположения, такие как Сэмюэл Батлер "s"Дарвин среди машин."[16]В настоящее время искусственный интеллект стал постоянной темой научной фантастики.

Автоматы

Реалистичный гуманоид автоматы были построены мастерами всех цивилизаций, в том числе Ян Ши,[17]Герой Александрии,[18]Аль-Джазари,[19] Пьер Жаке-Дро, и Вольфганг фон Кемпелен.[20]Самыми старыми из известных автоматов были священные статуи из древний Египет и Греция. Верующие верили, что мастер наделил эти фигуры очень реальным разумом, способным на мудрость и эмоции -Гермес Трисмегист писал, что «открыв истинную природу богов, человек смог воспроизвести ее».[21][22]

Формальное рассуждение

Искусственный интеллект основан на предположении, что процесс мышления человека можно механизировать. Изучение механического - или «формального» - мышления имеет долгую историю. Китайский, Индийский и Греческий Все философы разработали структурированные методы формальной дедукции в первом тысячелетии до нашей эры. Их идеи веками развивались такими философами, как Аристотель (который дал формальный анализ силлогизм ), Евклид (чья Элементы была образцом формальных рассуждений), аль-Хваризми (кто разработал алгебра и дал свое имя "алгоритм ") и европейский схоластический философы, такие как Уильям Оккам и Дунс Скот.[23]

Испанский философ Рамон Лулль (1232–1315) разработал несколько логические машины посвящен производству знания логическими средствами;[24] Ллулл описал свои машины как механические объекты, которые могут объединять основные и неоспоримые истины с помощью простых логических операций, производимых машиной с помощью механических значений, таким образом, чтобы произвести все возможные знания.[25] Работа Луллля оказала большое влияние на Готфрид Лейбниц, который переработал свои идеи.[26]

В 17 веке Лейбниц, Томас Гоббс и Рене Декарт исследовал возможность того, что всякая рациональная мысль может быть систематизирована, как алгебра или геометрия.[27]Гоббс классно написал в Левиафан: "разум есть не что иное, как расплата".[28]Лейбниц представил универсальный язык рассуждений (его характеристика универсалис ), который свел бы аргументацию к расчету, так что «между двумя философами не было бы больше необходимости в диспуте, чем между двумя бухгалтерами. друг в свидетели, если захотелось): Давайте посчитаем."[29]Эти философы начали формулировать система физических символов гипотеза, которая станет руководящей верой в исследованиях искусственного интеллекта.

В ХХ веке изучение математическая логика обеспечил существенный прорыв, который сделал искусственный интеллект правдоподобным. Основы были заложены такими работами, как Логический с Законы мысли и Frege с Begriffsschrift. Опираясь на Frege система, Рассел и Уайтхед представили формальную трактовку основ математики в своем шедевре, Principia Mathematica в 1913 году. Вдохновленный Рассел успех, Дэвид Гильберт Предложил математикам 20-30-х годов ответить на этот фундаментальный вопрос: «Можно ли формализовать все математические рассуждения?»[23]На его вопрос ответил Гёдель с доказательство неполноты, Тьюринг с машина и Церковь с Лямбда-исчисление.[23][30]

Их ответ был удивительным с двух сторон. Во-первых, они доказали, что на самом деле существуют пределы возможностей математической логики. Но во-вторых (и это более важно для ИИ) их работа предполагала, что в этих пределах Любые форма математических рассуждений может быть механизирована. В Тезис Черча-Тьюринга подразумевает, что механическое устройство, перетасовывающее такие простые символы, как 0 и 1, может имитировать любой мыслимый процесс математического вывода. Ключевой вывод был Машина Тьюринга - простая теоретическая конструкция, отражающая суть манипулирования абстрактными символами. Это изобретение вдохновит горстку ученых начать обсуждение возможности мыслящих машин.[23][32]

Информатика

Счетные машины были построены в древности и совершенствовались на протяжении всей истории многими математиками, включая (снова) философа. Готфрид Лейбниц. В начале 19 века Чарльз Бэббидж разработал программируемый компьютер ( Аналитическая машина ), хотя так и не был построен. Ада Лавлейс предположил, что машина «могла бы сочинять сложные и научные музыкальные произведения любой степени сложности или степени».[33] (Ее часто называют первым программистом из-за набор заметок она написала, что полностью детализирует метод расчета Числа Бернулли с двигателем.)

Первые современные компьютеры были массовыми машинами для взлома кода Вторая мировая война (такие как Z3, ENIAC и Колосс ). Последние две из этих машин были основаны на теоретической основе, заложенной Алан Тьюринг[34] и разработан Джон фон Нейман.[35]

Рождение искусственного интеллекта 1952–1956 гг.

В 1940-х и 50-х годах горстка ученых из самых разных областей (математика, психология, инженерия, экономика и политология) начали обсуждать возможность создания искусственного мозга. Поле искусственный интеллект Исследования были основаны как академическая дисциплина в 1956 году.

Кибернетика и ранние нейронные сети

Первые исследования мыслящих машин были вдохновлены слиянием идей, которые стали преобладать в конце 1930-х, 1940-х и начале 1950-х годов. Недавние исследования в неврология показали, что мозг представляет собой электрическую сеть нейроны которые стреляли импульсами "все или ничего". Норберт Винер с кибернетика описана управляемость и устойчивость в электрических сетях. Клод Шеннон с теория информации описанные цифровые сигналы (т.е. сигналы типа "все или ничего"). Алан Тьюринг с теория вычислений показали, что любую форму вычислений можно описать в цифровом виде. Тесная взаимосвязь между этими идеями наводит на мысль, что можно было бы построить электронный мозг.[36]

Примеры работы в этом ключе включают таких роботов, как В. Грей Уолтер с черепахи и Зверь Джона Хопкинса. Эти машины не использовали компьютеры, цифровую электронику или символическое мышление; они полностью управлялись аналоговой схемой.[37]

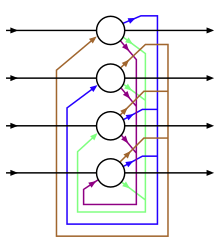

Уолтер Питтс и Уоррен МакКаллох проанализированы сети идеализированных искусственных нейроны и показал, как они могут выполнять простые логические функции в 1943 году.[38][39] Они были первыми, кто описал то, что позднее исследователи назвали нейронная сеть.[40] Один из студентов, вдохновленный Питтс и McCulloch был молодым Марвин Мински, затем 24-летний аспирант. В 1951 году (вместе с Дином Эдмондсом) он построил первую нейронную сетевую машину, SNARC.[41]Минский должен был стать одним из самых важных лидеров и новаторов в области искусственного интеллекта в течение следующих 50 лет.

Тест Тьюринга

В 1950 г. Алан Тьюринг опубликовал ориентир бумага в котором он размышлял о возможности создания мыслящих машин.[42]Он отметил, что "мышление" трудно определить, и разработал свой знаменитый Тест Тьюринга. Если бы машина могла поддерживать разговор (через телетайп ), что было неотличимо от разговора с человеком, тогда было разумно сказать, что машина «думала». Эта упрощенная версия проблемы позволила Тьюрингу убедительно доказать, что «мыслящая машина» была по крайней мере правдоподобный и статья ответила на все наиболее частые возражения против этого предложения.[43] В Тест Тьюринга было первым серьезным предложением в философия искусственного интеллекта.

ИИ игры

В 1951 г. Ферранти Марк 1 машина Манчестерский университет, Кристофер Стрейчи написал программу проверки и Дитрих Принц написал один для шахмат.[44] Артур Сэмюэл Программа шашек, разработанная в середине 50-х - начале 60-х годов, в конечном итоге достигла достаточных навыков, чтобы бросить вызов уважаемому любителю.[45] ИИ игры будет по-прежнему использоваться для измерения прогресса в области ИИ на протяжении всей его истории.

Символическое мышление и теоретик логики

Когда доступ к цифровые компьютеры Это стало возможным в середине пятидесятых годов, некоторые ученые инстинктивно осознали, что машина, которая может манипулировать числами, может также манипулировать символами, и что манипулирование символами вполне может быть сутью человеческого мышления. Это был новый подход к созданию мыслящих машин.[46]

В 1955 г. Аллен Ньюэлл и (будущий лауреат Нобелевской премии) Герберт А. Саймон создал "Теоретик логики "(с помощью Дж. К. Шоу ). Программа в конечном итоге доказала 38 из первых 52 теорем в Рассел и Уайтхеда Principia Mathematica, и найти для некоторых новые и более элегантные доказательства.[47]Саймон сказал, что они «решили почтенный проблема разума / тела, объясняя, как система, состоящая из материи, может обладать свойствами разума ".[48](Это было раннее изложение философской позиции Джон Сирл позже позвонит "Сильный ИИ ": машины могут содержать разум так же, как и человеческие тела.)[49]

Дартмутская конференция 1956: рождение искусственного интеллекта

В Дартмутская конференция 1956 г.[50]был организован Марвин Мински, Джон Маккарти и два старших научных сотрудника: Клод Шеннон и Натан Рочестер из IBM. Предложение для конференции включало следующее утверждение: «Каждый аспект обучения или любая другая особенность интеллекта может быть описана так точно, что может быть создана машина для его моделирования».[51]В числе участников Рэй Соломонов, Оливер Селфридж, Тренчард Подробнее, Артур Сэмюэл, Аллен Ньюэлл и Герберт А. Саймон, все они будут создавать важные программы в течение первых десятилетий исследований ИИ.[52]На конференции Ньюэлл и Саймон представили "Теоретик логики »и Маккарти убедил участников принять« искусственный интеллект »в качестве названия области.[53]Конференция в Дартмуте 1956 года стала моментом, когда ИИ получил свое имя, свою миссию, свой первый успех и своих основных игроков, и широко считается рождением ИИ.[54] Термин «искусственный интеллект» был выбран Маккарти, чтобы избежать ассоциаций с кибернетика и связи с влиятельным кибернетиком Норберт Винер.[55]

Золотые годы 1956–1974

Программы, разработанные после Дартмутского семинара, были для большинства просто «поразительными»:[56] компьютеры решали задачи по алгебре, доказывали геометрические теоремы и учились говорить по-английски. Мало кто в то время мог поверить, что такое «разумное» поведение машин вообще возможно.[57] Исследователи выразили глубокий оптимизм в частных беседах и в печати, предсказывая, что полностью интеллектуальная машина будет построена менее чем за 20 лет.[58] Государственные учреждения, такие как DARPA вливали деньги в новое поле.[59]

Работа

В конце 50-х и 60-х было много успешных программ и новых направлений. Среди наиболее влиятельных были следующие:

Рассуждение как поиск

Многие ранние программы ИИ использовали одни и те же базовые алгоритм. Чтобы достичь какой-то цели (например, выиграть игру или доказать теорему), они шаг за шагом продвигались к ней (делая ход или дедукцию), как будто пробирались в лабиринте, возврат всякий раз, когда они заходили в тупик. Эта парадигма получила название "рассуждение как поиск ".[60]

Основная трудность заключалась в том, что для многих задач количество возможных путей через «лабиринт» было просто астрономическим (ситуация, известная как «комбинаторный взрыв "). Исследователи сократят пространство поиска, используя эвристика или "эмпирические правила "это устранило бы те пути, которые вряд ли приведут к решению.[61]

Newell и Саймон попытался запечатлеть общую версию этого алгоритма в программе под названием "Решение общих проблем ".[62] Другие «поисковые» программы были способны выполнять впечатляющие задачи, такие как решение задач по геометрии и алгебре, например Герберт Гелернтер с Доказательство теорем о геометрии (1958) и СВЯТОЙ, написано Минского студент Джеймс Слэгл (1961).[63] Другие программы просматривали цели и подцели для планирования действий, например Полоски система разработана в Стэнфорд контролировать поведение своего робота Shakey.[64]

Естественный язык

Важная цель исследований искусственного интеллекта - позволить компьютерам общаться в естественные языки как английский. Ранний успех был Дэниел Боброу программа СТУДЕНТ, который мог решать задачи школьной алгебры.[65]

А семантическая сеть представляет концепции (например, «дом», «дверь») как узлы и отношения между концепциями (например, «имеет-а») как связи между узлами. Первая программа ИИ, использующая семантическую сеть, была написана Росс Куиллиан[66] и самым успешным (и спорный) версия была Роджер Шэнк с Теория концептуальной зависимости.[67]

Йозеф Вайценбаум с ELIZA могли вести беседы, которые были настолько реалистичны, что пользователи иногда ошибались, полагая, что они общаются с человеком, а не с программой. Но на самом деле ЭЛИЗА понятия не имела, о чем говорила. Она просто дала шаблонный ответ или повторил то, что ей сказали, перефразируя свой ответ с помощью нескольких грамматических правил. ЕЛИЗА была первой болтун.[68]

Микромиры

В конце 60-х гг. Марвин Мински и Сеймур Паперт из Массачусетский технологический институт Лаборатория ИИ предложила, чтобы исследования ИИ были сосредоточены на искусственно простых ситуациях, известных как микромиры. Они отметили, что в успешных науках, таких как физика, основные принципы часто лучше всего понимаются с помощью упрощенных моделей, таких как плоскости без трения или абсолютно твердые тела. Большая часть исследований была сосредоточена на "блокирует мир, "который состоит из цветных блоков различной формы и размера, расположенных на плоской поверхности.[69]

Эта парадигма привела к новаторской работе в машинное зрение от Джеральд Сассман (кто руководил командой), Адольфо Гусман, Дэвид Вальц (кто придумал "распространение ограничений "), и особенно Патрик Уинстон. В то же время, Минский и Papert построил руку робота, которая могла складывать блоки, оживляя мир блоков. Венцом программы микромира стало Терри Виноград с ШРДЛУ. Он мог общаться обычными английскими предложениями, планировать операции и выполнять их.[70]

Оптимизм

Первое поколение исследователей ИИ сделало следующие прогнозы о своей работе:

- 1958, Х. А. Саймон и Аллен Ньюэлл: «через десять лет цифровой компьютер станет чемпионом мира по шахматам» и «в течение десяти лет цифровой компьютер откроет и докажет новую важную математическую теорему».[71]

- 1965, Х. А. Саймон: «В течение двадцати лет машины будут способны выполнять любую работу, которую может выполнять человек».[72]

- 1967, Марвин Мински: «В течение одного поколения ... проблема создания« искусственного интеллекта »будет существенно решена».[73]

- 1970, Марвин Мински (в Жизнь Журнал ): «Через три-восемь лет у нас будет машина с общим интеллектом среднего человека».[74]

Деньги

В июне 1963 г. Массачусетский технологический институт получил грант в размере 2,2 миллиона долларов от недавно созданного Агентства перспективных исследовательских проектов (позже известного как DARPA ). Деньги были использованы для финансирования проект MAC которая включала "AI Group", основанную Минский и Маккарти пятью годами ранее. DARPA продолжал предоставлять три миллиона долларов в год до 70-х годов.[75]DARPA предоставил аналогичные гранты Newell и Саймона программа в CMU и к Стэнфордский проект ИИ (основан Джон Маккарти в 1963 г.).[76] Еще одна важная лаборатория ИИ была создана в Эдинбургский университет от Дональд Мичи в 1965 г.[77]Эти четыре института будут оставаться основными центрами исследований (и финансирования) ИИ в академических кругах на протяжении многих лет.[78]

Деньги были предложены с несколькими условиями: Дж. К. Р. Ликлайдер, затем директор ARPA, считал, что его организация должна «финансировать людей, а не проекты!» и позволил исследователям следовать любым интересующим их направлениям.[79] Это создало свободную атмосферу на Массачусетский технологический институт что породило хакерская культура,[80] но такой подход "руки прочь" длился недолго.

Робототехника

В Японии, Университет Васэда инициировал проект WABOT в 1967 году, а в 1972 году завершил WABOT-1, первый в мире полномасштабный интеллектуальный человекоподобный робот,[81][82] или андроид. Его система управления конечностями позволяла ему ходить нижними конечностями, а также захватывать и транспортировать предметы руками с помощью тактильных датчиков. Его система зрения позволяла измерять расстояния и направления до объектов с помощью внешних рецепторов, искусственных глаз и ушей. А его система разговора позволяла ему общаться с человеком на японском языке с искусственным ртом.[83][84][85]

Первый ИИ зимой 1974–1980 гг.

В 1970-х AI подвергался критике и финансовым неудачам. Исследователи искусственного интеллекта не смогли оценить сложность проблем, с которыми они столкнулись. Их огромный оптимизм породил невероятно высокие ожидания, и когда обещанные результаты не оправдались, финансирование ИИ исчезло.[86] В то же время поле коннекционизм (или нейронные сети ) был почти полностью остановлен на 10 лет Марвин Мински с разрушительная критика из перцептроны.[87]Несмотря на трудности с общественным восприятием ИИ в конце 70-х, новые идеи были исследованы в логическое программирование, здравый смысл и многие другие направления.[88]

Проблемы

В начале семидесятых возможности программ ИИ были ограничены. Даже самые впечатляющие могли справиться только с тривиальными версиями задач, которые они должны были решить; все программы были в каком-то смысле «игрушками».[89] Исследователи ИИ начали сталкиваться с несколькими фундаментальными ограничениями, которые нельзя было преодолеть в 1970-х годах. Хотя некоторые из этих ограничений будут преодолены в последующие десятилетия, другие все еще блокируют поле деятельности по сей день.[90]

- Ограниченная мощность компьютера: Недостаточно памяти или скорости обработки для выполнения чего-либо действительно полезного. Например, Росс Куиллиан успешная работа над естественным языком была продемонстрирована со словарным запасом только двадцать слова, потому что это все, что уместится в памяти.[91] Ганс Моравец В 1976 году утверждал, что компьютеры все еще в миллионы раз слишком слабы, чтобы проявлять интеллект. Он предложил аналогию: искусственный интеллект требует мощности компьютера так же, как и самолету. Лошадиные силы. Ниже определенного порога это невозможно, но, как мощность увеличивается, со временем это может стать легким.[92] Что касается компьютерного зрения, Моравек подсчитал, что простое сопоставление возможностей обнаружения границ и движения сетчатки глаза человека в реальном времени потребует универсального компьютера, способного 109 операций в секунду (1000 MIPS).[93] По состоянию на 2011 год для практических приложений компьютерного зрения требуется от 10 000 до 1 000 000 MIPS. Для сравнения: самый быстрый суперкомпьютер 1976 года Крей-1 (розничная цена от 5 до 8 миллионов долларов), была способна только от 80 до 130 MIPS, а типичный настольный компьютер в то время достигал менее 1 MIPS.

- Несговорчивость и комбинаторный взрыв. В 1972 г. Ричард Карп (опираясь на Стивен Кук 1971 год теорема ) показал, что есть много проблем это, вероятно, может быть решено только в экспоненциальное время (по размеру входов). Поиск оптимальных решений этих проблем требует невообразимого количества компьютерного времени, за исключением тех случаев, когда проблемы тривиальны. Это почти наверняка означало, что многие из «игрушечных» решений, используемых ИИ, вероятно, никогда не превратятся в полезные системы.[94]

- Здравый смысл и рассуждение. Многие важные приложения искусственного интеллекта, такие как видение или естественный язык требуют просто огромного количества информации о мире: программа должна иметь некоторое представление о том, на что она может смотреть или о чем говорит. Для этого необходимо, чтобы программа знала о мире почти то же самое, что и ребенок. Вскоре исследователи обнаружили, что это действительно обширный количество информации. Никто в 1970 году не мог построить такую большую базу данных, и никто не знал, как программа может получить такой объем информации.[95]

- Парадокс Моравца: Доказательство теорем и решение геометрических задач сравнительно легко для компьютеров, но якобы простая задача, такая как распознавание лица или пересечение комнаты, не натыкаясь ни на что, чрезвычайно сложна. Это помогает объяснить, почему исследования видение и робототехника к середине 1970-х гг.[96]

- В Рамка и проблемы с квалификацией. Исследователи ИИ (например, Джон Маккарти ) кто использовал логика обнаружил, что они не могут представлять собой обычные выводы, связанные с планирование или рассуждения по умолчанию без внесения изменений в структуру самой логики. Они разработали новую логику (например, немонотонная логика и модальная логика ), чтобы попытаться решить проблемы.[97]

Конец финансирования

Агентства, которые финансировали исследования ИИ (например, Британское правительство, DARPA и NRC ) был разочарован отсутствием прогресса и в конце концов прекратил почти все финансирование ненаправленных исследований в области ИИ. Эта модель зародилась еще в 1966 году, когда ALPAC появился отчет с критикой усилий по машинному переводу. Потратив 20 миллионов долларов, NRC прекратил всякую поддержку.[98]В 1973 г. Отчет Лайтхилла о состоянии исследований искусственного интеллекта в Англии критиковали полную неспособность искусственного интеллекта достичь своих «грандиозных целей» и привели к свертыванию исследований искусственного интеллекта в этой стране.[99](В отчете конкретно упоминается комбинаторный взрыв проблема как причина неудач ИИ.)[100]DARPA был глубоко разочарован исследователями, работающими над Исследование понимания речи программа в CMU и отменил ежегодный грант в три миллиона долларов.[101]К 1974 году найти финансирование для проектов ИИ было трудно.

Ганс Моравец объяснил кризис нереалистичными прогнозами своих коллег. «Многие исследователи попали в сеть растущих преувеличений».[102]Однако возникла еще одна проблема: поскольку прохождение Поправка Мэнсфилда в 1969 г., DARPA находился под растущим давлением, чтобы финансировать «целенаправленное прямое исследование, а не фундаментальное неориентированное исследование». Финансирование творческих, вольных исследований, начавшихся в 60-е годы, не поступало из DARPA. Вместо этого деньги были направлены на конкретные проекты с четкими целями, такие как автономные танки и системы управления боем.[103]

Критика со всего кампуса

Некоторые философы категорически возражали против заявлений исследователей ИИ. Один из первых был Джон Лукас, который утверждал, что Теорема Гёделя о неполноте показал, что формальная система (например, компьютерная программа) никогда не могла видеть истинность определенных утверждений, в то время как человек мог.[104] Хуберт Дрейфус высмеивал невыполненные обещания 1960-х годов и критиковал предположения ИИ, утверждая, что человеческое мышление на самом деле включает в себя очень мало «обработки символов» и много воплощенный, инстинктивный, без сознания "секрет производства ".[105][106] Джон Сирл с Китайская комната Аргумент, представленный в 1980 году, попытался показать, что нельзя сказать, что программа «понимает» символы, которые она использует (качество, называемое «преднамеренность Сирл утверждал, что если символы не имеют значения для машины, то машину нельзя назвать «думающей».[107]

Эти критические замечания не воспринимались серьезно исследователями ИИ, часто потому, что они казались далекими от сути. Проблемы вроде несговорчивость и здравый смысл казался более непосредственным и серьезным. Было непонятно, какая разница »секрет производства " или "преднамеренность "преобразовано в настоящую компьютерную программу. Минский сказал о Дрейфусе и Сирле, «они неправильно понимают, и их следует игнорировать».[108] Дрейфус, преподававший в Массачусетский технологический институт, был встречен холодно: позже он сказал, что исследователи ИИ «не осмелились быть замеченными за обедом со мной».[109] Йозеф Вайценбаум, автор ELIZA, почувствовал, как его коллеги обращаются с Дрейфус было непрофессионально и по-детски. Хотя он был откровенным критиком позиции Дрейфуса, он «сознательно дал понять, что их позиция - не способ обращения с человеком».[110]

Вайценбаум начал испытывать серьезные этические сомнения в отношении ИИ, когда Кеннет Колби написал «компьютерную программу, которая может вести психотерапевтический диалог» на основе ELIZA.[111] Вайценбаум был обеспокоен тем, что Колби видел в бессмысленной программе серьезный терапевтический инструмент. Началась вражда, и ситуация не улучшилась, когда Колби не поверил Вайценбауму за его вклад в программу. В 1976 г. Weizenbaum опубликовано Компьютерная мощь и человеческий разум которые утверждали, что неправильное использование искусственного интеллекта может обесценить человеческую жизнь.[112]

Персептроны и атака на коннекционизм

А перцептрон была формой нейронная сеть введен в 1958 г. Фрэнк Розенблатт, который был одноклассником Марвин Мински на Средняя школа наук Бронкса. Как и большинство исследователей искусственного интеллекта, он с оптимизмом смотрел на их возможности, предсказывая, что «перцептрон со временем сможет учиться, принимать решения и переводить языки». Активная программа исследования парадигмы проводилась в течение 1960-х годов, но внезапно прекратилась с публикацией Минский и Паперта 1969 книга Персептроны. Он предположил, что существуют серьезные ограничения на то, что могут делать перцептроны, и что Фрэнк Розенблатт прогнозы России были сильно преувеличены. Эффект от книги был разрушительным: практически никаких исследований не проводилось. коннекционизм в течение 10 лет. В конечном итоге новое поколение исследователей возродит эту область, и после этого она станет жизненно важной и полезной частью искусственного интеллекта. Розенблатт не дожил бы до этого, так как он погиб в катастрофе вскоре после публикации книги.[87]

«Изящные»: логика и символические рассуждения

Логика была введена в исследования ИИ еще в 1959 г. Джон Маккарти в его Советник предложение.[113]В 1963 г. Дж. Алан Робинсон открыл простой метод выполнения дедукции на компьютерах, разрешающая способность и объединение алгоритм. However, straightforward implementations, like those attempted by McCarthy and his students in the late 1960s, were especially intractable: the programs required astronomical numbers of steps to prove simple theorems.[114] A more fruitful approach to logic was developed in the 1970s by Robert Kowalski на Эдинбургский университет, and soon this led to the collaboration with French researchers Alain Colmerauer и Philippe Roussel who created the successful logic programming language Пролог.[115]Prolog uses a subset of logic (Horn clauses, closely related to "rules" and "production rules ") that permit tractable computation. Rules would continue to be influential, providing a foundation for Edward Feigenbaum с expert systems and the continuing work by Allen Newell и Herbert A. Simon that would lead to Парить и их unified theories of cognition.[116]

Critics of the logical approach noted, as Dreyfus had, that human beings rarely used logic when they solved problems. Experiments by psychologists like Peter Wason, Eleanor Rosch, Amos Tversky, Daniel Kahneman and others provided proof.[117]McCarthy responded that what people do is irrelevant. He argued that what is really needed are machines that can solve problems—not machines that think as people do.[118]

The "scruffies": frames and scripts

Among the critics of McCarthy's approach were his colleagues across the country at Массачусетский технологический институт. Marvin Minsky, Seymour Papert и Roger Schank were trying to solve problems like "story understanding" and "object recognition" that required a machine to think like a person. In order to use ordinary concepts like "chair" or "restaurant" they had to make all the same illogical assumptions that people normally made. Unfortunately, imprecise concepts like these are hard to represent in logic. Gerald Sussman observed that "using precise language to describe essentially imprecise concepts doesn't make them any more precise."[119] Schank described their "anti-logic" approaches as "scruffy ", as opposed to the "neat " paradigms used by Маккарти, Ковальски, Feigenbaum, Newell и Саймон.[120]

In 1975, in a seminal paper, Minsky noted that many of his fellow "scruffy" researchers were using the same kind of tool: a framework that captures all our common sense assumptions about something. For example, if we use the concept of a bird, there is a constellation of facts that immediately come to mind: we might assume that it flies, eats worms and so on. We know these facts are not always true and that deductions using these facts will not be "logical", but these structured sets of assumptions are part of the контекст of everything we say and think. He called these structures "frames ". Schank used a version of frames he called "скрипты " to successfully answer questions about short stories in English.[121] Many years later object-oriented programming would adopt the essential idea of "inheritance " from AI research on frames.

Boom 1980–1987

In the 1980s a form of AI program called "expert systems " was adopted by corporations around the world and knowledge became the focus of mainstream AI research. In those same years, the Japanese government aggressively funded AI with its fifth generation computer проект. Another encouraging event in the early 1980s was the revival of connectionism in the work of John Hopfield и David Rumelhart. Once again, AI had achieved success.[122]

The rise of expert systems

An expert system is a program that answers questions or solves problems about a specific domain of knowledge, using logical правила that are derived from the knowledge of experts. The earliest examples were developed by Edward Feigenbaum and his students. Dendral, begun in 1965, identified compounds from spectrometer readings. MYCIN, developed in 1972, diagnosed infectious blood diseases. They demonstrated the feasibility of the approach.[123]

Expert systems restricted themselves to a small domain of specific knowledge (thus avoiding the commonsense knowledge problem) and their simple design made it relatively easy for programs to be built and then modified once they were in place. All in all, the programs proved to be useful: something that AI had not been able to achieve up to this point.[124]

In 1980, an expert system called XCON was completed at CMU для Digital Equipment Corporation. It was an enormous success: it was saving the company 40 million dollars annually by 1986.[125] Corporations around the world began to develop and deploy expert systems and by 1985 they were spending over a billion dollars on AI, most of it to in-house AI departments. An industry grew up to support them, including hardware companies like Symbolics и Lisp Machines and software companies such as IntelliCorp и Aion.[126]

The knowledge revolution

The power of expert systems came from the expert knowledge they contained. They were part of a new direction in AI research that had been gaining ground throughout the 70s. "AI researchers were beginning to suspect—reluctantly, for it violated the scientific canon of parsimony—that intelligence might very well be based on the ability to use large amounts of diverse knowledge in different ways,"[127] writes Pamela McCorduck. "[T]he great lesson from the 1970s was that intelligent behavior depended very much on dealing with knowledge, sometimes quite detailed knowledge, of a domain where a given task lay".[128] Knowledge based systems и knowledge engineering became a major focus of AI research in the 1980s.[129]

The 1980s also saw the birth of Cyc, the first attempt to attack the commonsense knowledge problem directly, by creating a massive database that would contain all the mundane facts that the average person knows. Douglas Lenat, who started and led the project, argued that there is no shortcut ― the only way for machines to know the meaning of human concepts is to teach them, one concept at a time, by hand. The project was not expected to be completed for many decades.[130]

Chess playing programs HiTech и Deep Thought defeated chess masters in 1989. Both were developed by Университет Карнеги Меллон; Deep Thought development paved the way for Темно-синий.[131]

The money returns: the Fifth Generation project

In 1981, the Japanese Ministry of International Trade and Industry set aside $850 million for the Fifth generation computer проект. Their objectives were to write programs and build machines that could carry on conversations, translate languages, interpret pictures, and reason like human beings.[132] Much to the chagrin of scruffies, they chose Пролог as the primary computer language for the project.[133]

Other countries responded with new programs of their own. The UK began the £350 million Alvey проект. A consortium of American companies formed the Microelectronics and Computer Technology Corporation (or "MCC") to fund large scale projects in AI and information technology.[134][135] DARPA responded as well, founding the Strategic Computing Initiative and tripling its investment in AI between 1984 and 1988.[136]

The revival of connectionism

In 1982, physicist John Hopfield was able to prove that a form of neural network (now called a "Hopfield net ") could learn and process information in a completely new way. Around the same time, Geoffrey Hinton и David Rumelhart popularized a method for training neural networks called "backpropagation ", also known as the reverse mode of automatic differentiation опубликовано Seppo Linnainmaa (1970) and applied to neural networks by Paul Werbos. These two discoveries helped to revive the field of connectionism.[135][137]

The new field was unified and inspired by the appearance of Parallel Distributed Processing in 1986—a two volume collection of papers edited by Rumelhart и психолог James McClelland. Neural networks would become commercially successful in the 1990s, when they began to be used as the engines driving programs like optical character recognition и speech recognition.[135][138]

The development of metal–oxide–semiconductor (MOS) very-large-scale integration (VLSI), in the form of complementary MOS (CMOS ) technology, enabled the development of practical artificial neural network (ANN) technology in the 1980s. A landmark publication in the field was the 1989 book Analog VLSI Implementation of Neural Systems by Carver A. Mead and Mohammed Ismail.[139]

Bust: the second AI winter 1987–1993

The business community's fascination with AI rose and fell in the 1980s in the classic pattern of an economic bubble. The collapse was in the восприятие of AI by government agencies and investors – the field continued to make advances despite the criticism. Rodney Brooks и Hans Moravec, researchers from the related field of робототехника, argued for an entirely new approach to artificial intelligence.

AI winter

Период, термин "AI winter " was coined by researchers who had survived the funding cuts of 1974 when they became concerned that enthusiasm for expert systems had spiraled out of control and that disappointment would certainly follow.[140] Their fears were well founded: in the late 1980s and early 1990s, AI suffered a series of financial setbacks.

The first indication of a change in weather was the sudden collapse of the market for specialized AI hardware in 1987. Desktop computers from яблоко и IBM had been steadily gaining speed and power and in 1987 they became more powerful than the more expensive Lisp machines сделано в Symbolics и другие. There was no longer a good reason to buy them. An entire industry worth half a billion dollars was demolished overnight.[141]

Eventually the earliest successful expert systems, such as XCON, proved too expensive to maintain. They were difficult to update, they could not learn, they were "brittle " (i.e., they could make grotesque mistakes when given unusual inputs), and they fell prey to problems (such as the qualification problem ) that had been identified years earlier. Expert systems proved useful, but only in a few special contexts.[142]

In the late 1980s, the Strategic Computing Initiative cut funding to AI "deeply and brutally." New leadership at DARPA had decided that AI was not "the next wave" and directed funds towards projects that seemed more likely to produce immediate results.[143]

By 1991, the impressive list of goals penned in 1981 for Japan's Fifth Generation Project had not been met. Indeed, some of them, like "carry on a casual conversation" had not been met by 2010.[144] As with other AI projects, expectations had run much higher than what was actually possible.[144]

Over 300 AI companies had shutdown, gone bankrupt, or been acquired by the end of 1993, effectively ending the first commercial wave of AI.[145]

Nouvelle AI and embodied reason

In the late 1980s, several researchers advocated a completely new approach to artificial intelligence, based on robotics.[146] They believed that, to show real intelligence, a machine needs to have a body — it needs to perceive, move, survive and deal with the world. They argued that these sensorimotor skills are essential to higher level skills like commonsense reasoning and that abstract reasoning was actually the least interesting or important human skill (see Moravec's paradox ). They advocated building intelligence "from the bottom up."[147]

The approach revived ideas from cybernetics и control theory that had been unpopular since the sixties. Another precursor was David Marr, who had come to Массачусетский технологический институт in the late 1970s from a successful background in theoretical neuroscience to lead the group studying видение. He rejected all symbolic approaches (и то и другое McCarthy's logic and Minsky 's frames), arguing that AI needed to understand the physical machinery of vision from the bottom up before any symbolic processing took place. (Marr's work would be cut short by leukemia in 1980.)[148]

In a 1990 paper, "Elephants Don't Play Chess,"[149] robotics researcher Rodney Brooks took direct aim at the physical symbol system hypothesis, arguing that symbols are not always necessary since "the world is its own best model. It is always exactly up to date. It always has every detail there is to be known. The trick is to sense it appropriately and often enough."[150] In the 1980s and 1990s, many cognitive scientists also rejected the symbol processing model of the mind and argued that the body was essential for reasoning, a theory called the embodied mind thesis.[151]

AI 1993–2011

The field of AI, now more than a half a century old, finally achieved some of its oldest goals. It began to be used successfully throughout the technology industry, although somewhat behind the scenes. Some of the success was due to increasing computer power and some was achieved by focusing on specific isolated problems and pursuing them with the highest standards of scientific accountability. Still, the reputation of AI, in the business world at least, was less than pristine. Inside the field there was little agreement on the reasons for AI's failure to fulfill the dream of human level intelligence that had captured the imagination of the world in the 1960s. Together, all these factors helped to fragment AI into competing subfields focused on particular problems or approaches, sometimes even under new names that disguised the tarnished pedigree of "artificial intelligence".[152] AI was both more cautious and more successful than it had ever been.

Milestones and Moore's law

On 11 May 1997, Темно-синий became the first computer chess-playing system to beat a reigning world chess champion, Гарри Каспаров.[153] The super computer was a specialized version of a framework produced by IBM, and was capable of processing twice as many moves per second as it had during the first match (which Deep Blue had lost), reportedly 200,000,000 moves per second. The event was broadcast live over the internet and received over 74 million hits.[154]

In 2005, a Stanford robot won the DARPA Grand Challenge by driving autonomously for 131 miles along an unrehearsed desert trail.[155] Two years later, a team from CMU won the DARPA Urban Challenge by autonomously navigating 55 miles in an Urban environment while adhering to traffic hazards and all traffic laws.[156] In February 2011, in a Jeopardy! quiz show exhibition match, IBM с question answering system, Watson, defeated the two greatest Jeopardy! champions, Brad Rutter и Ken Jennings, by a significant margin.[157]

These successes were not due to some revolutionary new paradigm, but mostly on the tedious application of engineering skill and on the tremendous increase in the speed and capacity of computer by the 90s.[158] In fact, Deep Blue's computer was 10 million times faster than the Ferranti Mark 1 это Christopher Strachey taught to play chess in 1951.[159] This dramatic increase is measured by Moore's law, which predicts that the speed and memory capacity of computers doubles every two years, as a result of metal–oxide–semiconductor (MOS) transistor counts doubling every two years. The fundamental problem of "raw computer power" was slowly being overcome.

Intelligent agents

A new paradigm called "intelligent agents " became widely accepted during the 1990s.[160] Although earlier researchers had proposed modular "divide and conquer" approaches to AI,[161] то intelligent agent did not reach its modern form until Judea Pearl, Allen Newell, Leslie P. Kaelbling, and others brought concepts from decision theory and economics into the study of AI.[162] Когда economist's definition of a rational agent was married to Информатика 's definition of an object или модуль, то intelligent agent paradigm was complete.

An intelligent agent is a system that perceives its environment and takes actions which maximize its chances of success. By this definition, simple programs that solve specific problems are "intelligent agents", as are human beings and organizations of human beings, such as firms. В intelligent agent paradigm defines AI research as "the study of intelligent agents". This is a generalization of some earlier definitions of AI: it goes beyond studying human intelligence; it studies all kinds of intelligence.[163]

The paradigm gave researchers license to study isolated problems and find solutions that were both verifiable and useful. It provided a common language to describe problems and share their solutions with each other, and with other fields that also used concepts of abstract agents, like economics and control theory. It was hoped that a complete agent architecture (like Newell's SOAR ) would one day allow researchers to build more versatile and intelligent systems out of interacting intelligent agents.[162][164]

The "victory of the neats"

AI researchers began to develop and use sophisticated mathematical tools more than they ever had in the past.[165] There was a widespread realization that many of the problems that AI needed to solve were already being worked on by researchers in fields like математика, economics or operations research. The shared mathematical language allowed both a higher level of collaboration with more established and successful fields and the achievement of results which were measurable and provable; AI had become a more rigorous "scientific" discipline. Russell & Norvig (2003) describe this as nothing less than a "revolution" and "the victory of the neats ".[166][167]

Judea Pearl 's influential 1988 book[168] принес probability и decision theory into AI. Among the many new tools in use were Bayesian networks, hidden Markov models, information theory, stochastic modeling and classical optimization. Precise mathematical descriptions were also developed for "computational intelligence " paradigms like нейронные сети и evolutionary algorithms.[166]

AI behind the scenes

Algorithms originally developed by AI researchers began to appear as parts of larger systems. AI had solved a lot of very difficult problems[169]and their solutions proved to be useful throughout the technology industry,[170] такие какdata mining,industrial robotics,logistics,[171]speech recognition,[172]banking software,[173]medical diagnosis[173]и Google 's search engine.[174]

The field of AI received little or no credit for these successes in the 1990s and early 2000s. Many of AI's greatest innovations have been reduced to the status of just another item in the tool chest of computer science.[175] Nick Bostrom explains "A lot of cutting edge AI has filtered into general applications, often without being called AI because once something becomes useful enough and common enough it's not labeled AI anymore."[176]

Many researchers in AI in the 1990s deliberately called their work by other names, such as informatics, knowledge-based systems, cognitive systems или computational intelligence. In part, this may have been because they considered their field to be fundamentally different from AI, but also the new names help to procure funding. In the commercial world at least, the failed promises of the AI Winter continued to haunt AI research into the 2000s, as the New York Times reported in 2005: "Computer scientists and software engineers avoided the term artificial intelligence for fear of being viewed as wild-eyed dreamers."[177][178][179]

Predictions (or "Where is HAL 9000?")

In 1968, Arthur C. Clarke и Стэнли Кубрик had imagined that, by the year 2001, a machine would exist with an intelligence that matched or exceeded the capability of human beings. The character they created, HAL 9000, was based on a belief shared by many leading AI researchers that such a machine would exist by the year 2001.[180]

In 2001, AI founder Marvin Minsky asked "So the question is why didn't we get HAL in 2001?"[181] Minsky believed that the answer is that the central problems, like commonsense reasoning, were being neglected, while most researchers pursued things like commercial applications of neural nets или genetic algorithms. John McCarthy, on the other hand, still blamed the qualification problem.[182] For Ray Kurzweil, the issue is computer power and, using Moore's Law, he predicted that machines with human-level intelligence will appear by 2029.[183] Jeff Hawkins argued that neural net research ignores the essential properties of the human кора, preferring simple models that have been successful at solving simple problems.[184] There were many other explanations and for each there was a corresponding research program underway.

Deep learning, big data and artificial general intelligence: 2011–present

In the first decades of the 21st century, access to large amounts of data (known as "big data "), cheaper and faster computers и продвинутый machine learning techniques were successfully applied to many problems throughout the economy. In fact, McKinsey Global Institute estimated in their famous paper "Big data: The next frontier for innovation, competition, and productivity" that "by 2009, nearly all sectors in the US economy had at least an average of 200 terabytes of stored data".

By 2016, the market for AI-related products, hardware, and software reached more than 8 billion dollars, and the New York Times reported that interest in AI had reached a "frenzy".[185] The applications of big data began to reach into other fields as well, such as training models in экология[186] and for various applications in экономика.[187] Advances in deep learning (particularly deep convolutional neural networks и recurrent neural networks ) drove progress and research in image and video processing, text analysis, and even speech recognition.[188]

Deep learning

Deep learning is a branch of machine learning that models high level abstractions in data by using a deep graph with many processing layers.[188] Согласно Universal approximation theorem, deep-ness isn't necessary for a neural network to be able to approximate arbitrary continuous functions. Even so, there are many problems that are common to shallow networks (such as overfitting ) that deep networks help avoid.[189] As such, deep neural networks are able to realistically generate much more complex models as compared to their shallow counterparts.

However, deep learning has problems of its own. A common problem for recurrent neural networks это vanishing gradient problem, which is where gradients passed between layers gradually shrink and literally disappear as they are rounded off to zero. There have been many methods developed to approach this problem, such as Long short-term memory units.

State-of-the-art deep neural network architectures can sometimes even rival human accuracy in fields like computer vision, specifically on things like the MNIST database, and traffic sign recognition.[190]

Language processing engines powered by smart search engines can easily beat humans at answering general trivia questions (such as IBM Watson ), and recent developments in deep learning have produced astounding results in competing with humans, in things like Идти, и Doom (which, being a first-person shooter game, has sparked some controversy).[191][192][193][194]

Большое количество данных

Big data refers to a collection of data that cannot be captured, managed, and processed by conventional software tools within a certain time frame. It is a massive amount of decision-making, insight, and process optimization capabilities that require new processing models. In the Big Data Era written by Victor Meyer Schonberg and Kenneth Cooke, big data means that instead of random analysis (sample survey), all data is used for analysis. The 5V characteristics of big data (proposed by IBM): Volume, Velocity, Разнообразие[195], Ценность[196], Veracity[197].The strategic significance of big data technology is not to master huge data information, but to specialize in these meaningful data. In other words, if big data is likened to an industry, the key to realizing profitability in this industry is to increase the "Process capability " of the data and realize the "Добавленная стоимость " of the data through "Processing ".

Общий искусственный интеллект

General intelligence is the ability to solve Любые problem, rather than finding a solution to a particular problem. Artificial general intelligence (or "AGI") is a program which can apply intelligence to a wide variety of problems, in much the same ways humans can.

Ben Goertzel and others argued in the early 2000s that AI research had largely given up on the field's original goal of creating artificial general intelligence. AGI research was founded as a separate sub-field and by 2010 there were academic conferences, laboratories and university courses dedicated to AGI research, as well as private consortiums and new companies.

Artificial general intelligence is also referred to as "strong AI"[198] or "full AI"[199] as opposed to "weak AI " or "narrow AI". (Academic sources reserve "strong AI" to refer to machines capable of experiencing consciousness.)

Смотрите также

- Outline of artificial intelligence

- Timeline of machine learning

- History of knowledge representation and reasoning

Заметки

- ^ Kaplan, Andreas; Haenlein, Michael (2019). "Siri, Siri, in my hand: Who's the fairest in the land? On the interpretations, illustrations, and implications of artificial intelligence". Business Horizons. 62: 15–25. Дои:10.1016/j.bushor.2018.08.004.

- ^ The Talos episode in Argonautica 4

- ^ Bibliotheke 1.9.26

- ^ Rhodios, Apollonios. (2007). The Argonautika : Expanded Edition. Калифорнийский университет Press. п. 355. ISBN 978-0-520-93439-9. OCLC 811491744.

- ^ Morford, Mark (2007). Classical mythology. Oxford. п. 184. ISBN 978-0-19-085164-4. OCLC 1102437035.

- ^ Pseudo-Apollodorus, Bibliotheke, iii.14.3

- ^ Kressel, Matthew (1 October 2015). "36 Days of Judaic Myth: Day 24, The Golem of Prague". Matthew Kressel. Получено 15 марта 2020.

- ^ "GOLEM - JewishEncyclopedia.com". www.jewishencyclopedia.com. Получено 15 марта 2020.

- ^ "Sanhedrin 65b". www.sefaria.org. Получено 15 марта 2020.

- ^ The alchemy reader : from Hermes Trismegistus to Isaac Newton. Linden, Stanton J., 1935-. Нью-Йорк: Издательство Кембриджского университета. 2003. pp. Ch. 18. ISBN 0-521-79234-7. OCLC 51210362.CS1 maint: другие (ссылка на сайт)

- ^ O'Connor, Kathleen Malone (1 January 1994). "The alchemical creation of life (takwin) and other concepts of Genesis in medieval Islam". Dissertations Available from ProQuest: 1–435.

- ^ Goethe, Johann Wolfgang von (1890). Faust; a tragedy. Translated, in the original metres ... by Bayard Taylor. Authorised ed., published by special arrangement with Mrs. Bayard Taylor. With a biographical introd. Robarts - University of Toronto. London Ward, Lock.

- ^ Butler, E. M. (Eliza Marian) (1948). The myth of the magus. London: Cambridge University Press. ISBN 0-521-22564-7. OCLC 5063114.

- ^ Hollander, Lee M. (1964). Heimskringla; history of the kings of Norway. Austin: Published for the American-Scandinavian Foundation by the University of Texas Press. ISBN 0-292-73061-6. OCLC 638953.

- ^ McCorduck 2004, pp. 17–25.

- ^ Butler 1863.

- ^ Needham 1986, п. 53

- ^ McCorduck 2004, п. 6

- ^ Nick 2005.

- ^ McCorduck 2004, п. 17 and see also Levitt 2000

- ^ Quoted in McCorduck 2004, п. 8. Crevier 1993, п. 1 и McCorduck 2004, pp. 6–9 discusses sacred statues.

- ^ Other important automata were built by Haroun al-Rashid (McCorduck 2004, п. 10), Jacques de Vaucanson (McCorduck 2004, п. 16) and Leonardo Torres y Quevedo (McCorduck 2004, pp. 59–62)

- ^ а б c d Berlinski 2000

- ^ Cfr. Carreras Artau, Tomás y Joaquín. Historia de la filosofía española. Filosofía cristiana de los siglos XIII al XV. Madrid, 1939, Volume I

- ^ Bonner, Anthonny, The Art and Logic of Ramón Llull: A User's Guide, Brill, 2007.

- ^ Anthony Bonner (ed.), Doctor Illuminatus. A Ramon Llull Reader (Princeton University 1985). Vid. "Llull's Influence: The History of Lullism" at 57–71

- ^ 17th century mechanism and AI:

- McCorduck 2004, pp. 37–46

- Russell & Norvig 2003, п. 6

- Haugeland 1986, chpt. 2

- Buchanan 2005, п. 53

- ^ Hobbes and AI:

- McCorduck 2004, п. 42

- Hobbes 1651, chapter 5

- ^ Leibniz and AI:

- McCorduck 2004, п. 41 год

- Russell & Norvig 2003, п. 6

- Berlinski 2000, п. 12

- Buchanan 2005, п. 53

- ^ В Lambda calculus was especially important to AI, since it was an inspiration for Лисп (the most important programming language used in AI). (Crevier 1993, pp. 190 196,61)

- ^ The original photo can be seen in the article: Rose, Allen (April 1946). "Lightning Strikes Mathematics". Популярная наука: 83–86. Получено 15 апреля 2012.

- ^ В Машина Тьюринга:McCorduck 2004, pp. 63–64,Crevier 1993, pp. 22–24,Russell & Norvig 2003, п. 8 and seeTuring 1936

- ^ Menabrea 1843

- ^ McCorduck 2004, pp. 61–62, 64–66, Russell & Norvig 2003, pp. 14–15

- ^ McCorduck (2004, pp. 76–80)

- ^ McCorduck 2004, pp. 51–57, 80–107,Crevier 1993, pp. 27–32,Russell & Norvig 2003, pp. 15, 940,Moravec 1988, п. 3,Cordeschi, 2002 & Chap. 5.

- ^ McCorduck 2004, п. 98, Crevier 1993, pp. 27–28, Russell & Norvig 2003, pp. 15, 940, Moravec 1988, п. 3, Cordeschi, 2002 & Chap. 5.

- ^ McCulloch, Warren S.; Pitts, Walter (1 December 1943). "A logical calculus of the ideas immanent in nervous activity". Bulletin of Mathematical Biophysics. 5 (4): 115–133. Дои:10.1007/BF02478259. ISSN 1522-9602.

- ^ Piccinini, Gualtiero (1 August 2004). "The First Computational Theory of Mind and Brain: A Close Look at Mcculloch and Pitts's "Logical Calculus of Ideas Immanent in Nervous Activity"". Synthese. 141 (2): 175–215. Дои:10.1023/B:SYNT.0000043018.52445.3e. ISSN 1573-0964. S2CID 10442035.

- ^ McCorduck 2004, pp. 51–57, 88–94, Crevier 1993, п. 30, Russell & Norvig 2003, п. 15−16, Cordeschi, 2002 & Chap. 5 and see also Pitts & McCullough 1943

- ^ McCorduck 2004, п. 102, Crevier 1993, pp. 34–35 и Russell & Norvig 2003, п. 17

- ^ McCorduck 2004, pp. 70–72,Crevier 1993, п. 22−25,Russell & Norvig 2003, pp. 2–3 and 948,Haugeland 1985, pp. 6–9,Cordeschi 2002, pp. 170–176.See alsoTuring 1950

- ^ Norvig & Russell (2003, п. 948) claim that Turing answered all the major objections to AI that have been offered in the years since the paper appeared.

- ^ Увидеть "A Brief History of Computing" at AlanTuring.net.

- ^ Schaeffer, Jonathan. One Jump Ahead:: Challenging Human Supremacy in Checkers, 1997,2009, Springer, ISBN 978-0-387-76575-4. Chapter 6.

- ^ McCorduck 2004, pp. 137–170, Crevier, pp. 44–47

- ^ McCorduck 2004, pp. 123–125, Crevier 1993, pp. 44–46 и Russell & Norvig 2003, п. 17

- ^ Quoted in Crevier 1993, п. 46 и Russell & Norvig 2003, п. 17

- ^ Russell & Norvig 2003, п. 947,952

- ^ McCorduck 2004, pp. 111–136,Crevier 1993, pp. 49–51 иRussell & Norvig 2003, п. 17Newquist 1994, pp. 91–112

- ^ Увидеть McCarthy et al. 1955. Также см Crevier 1993, п. 48 где Crevier states "[the proposal] later became known as the 'physical symbol systems hypothesis'". В physical symbol system hypothesis was articulated and named by Newell и Саймон in their paper on GPS. (Newell & Simon 1963 ) It includes a more specific definition of a "machine" as an agent that manipulates symbols. See the philosophy of artificial intelligence.

- ^ McCorduck (2004, pp. 129–130) discusses how the Dartmouth conference alumni dominated the first two decades of AI research, calling them the "invisible college".

- ^ "I won't swear and I hadn't seen it before," McCarthy told Pamela McCorduck in 1979. (McCorduck 2004, п. 114) However, Маккарти also stated unequivocally "I came up with the term" in a CNET interview. (Skillings 2006 )

- ^ Crevier (1993, pp. 49) writes "the conference is generally recognized as the official birthdate of the new science."

- ^ McCarthy, John (1988). "Обзор The Question of Artificial Intelligence". Annals of the History of Computing. 10 (3): 224–229., collected in McCarthy, John (1996). "10. Review of The Question of Artificial Intelligence". Defending AI Research: A Collection of Essays and Reviews. CSLI., п. 73"[O]ne of the reasons for inventing the term "artificial intelligence" was to escape association with "cybernetics". Its concentration on analog feedback seemed misguided, and I wished to avoid having either to accept Norbert (not Robert) Wiener as a guru or having to argue with him."

- ^ Russell and Norvig write "it was astonishing whenever a computer did anything remotely clever." Russell & Norvig 2003, п. 18

- ^ Crevier 1993, pp. 52–107, Moravec 1988, п. 9 and Russell & Norvig 2003, п. 18−21

- ^ McCorduck 2004, п. 218, Newquist 1994, pp. 91–112, Crevier 1993, pp. 108–109 и Russell & Norvig 2003, п. 21 год

- ^ Crevier 1993, pp. 52–107, Moravec 1988, п. 9

- ^ Means-ends analysis, reasoning as search: McCorduck 2004, pp. 247–248. Russell & Norvig 2003, pp. 59–61

- ^ Heuristic: McCorduck 2004, п. 246, Russell & Norvig 2003, pp. 21–22

- ^ GPS: McCorduck 2004, pp. 245–250, Crevier 1993, п. GPS?, Russell & Norvig 2003, п. GPS?

- ^ Crevier 1993, pp. 51–58,65–66 и Russell & Norvig 2003, pp. 18–19

- ^ McCorduck 2004, pp. 268–271, Crevier 1993, pp. 95–96, Newquist 1994, pp. 148–156, Moravec 1988, pp. 14–15

- ^ McCorduck 2004, п. 286, Crevier 1993, pp. 76–79, Russell & Norvig 2003, п. 19

- ^ Crevier 1993, pp. 79–83

- ^ Crevier 1993, pp. 164–172

- ^ McCorduck 2004, pp. 291–296, Crevier 1993, pp. 134–139

- ^ McCorduck 2004, pp. 299–305, Crevier 1993, pp. 83–102, Russell & Norvig 2003, п. 19 и Copeland 2000

- ^ McCorduck 2004, pp. 300–305, Crevier 1993, pp. 84–102, Russell & Norvig 2003, п. 19

- ^ Simon & Newell 1958, п. 7−8 quoted in Crevier 1993, п. 108. Смотрите также Russell & Norvig 2003, п. 21 год

- ^ Simon 1965, п. 96 quoted in Crevier 1993, п. 109

- ^ Minsky 1967, п. 2 quoted in Crevier 1993, п. 109

- ^ Minsky strongly believes he was misquoted. Увидеть McCorduck 2004, pp. 272–274, Crevier 1993, п. 96 и Darrach 1970.

- ^ Crevier 1993, pp. 64–65

- ^ Crevier 1993, п. 94

- ^ Howe 1994

- ^ McCorduck 2004, п. 131, Crevier 1993, п. 51. McCorduck also notes that funding was mostly under the direction of alumni of the Dartmouth conference of 1956.

- ^ Crevier 1993, п. 65

- ^ Crevier 1993, стр. 68–71 и Теркл 1984

- ^ "История гуманоидов -WABOT-".

- ^ Робототехника и мехатроника: материалы 4-го Международного симпозиума IFToMM по робототехнике и мехатронике, стр.66

- ^ «Исторические Android-проекты». androidworld.com.

- ^ Роботы: от научной фантастики до технологической революции, стр.130

- ^ Справочник по цифровому моделированию человека: исследования в области прикладной эргономики и инженерии человеческого фактора, Глава 3, страницы 1-2

- ^ Crevier 1993, стр. 100–144 и Рассел и Норвиг, 2003 г., стр. 21–22

- ^ а б МакКордак 2004, стр. 104–107,Crevier 1993, стр. 102–105,Рассел и Норвиг, 2003 г., п. 22

- ^ Crevier 1993, стр. 163–196

- ^ Crevier 1993, п. 146

- ^ Рассел и Норвиг, 2003 г., стр. 20–21

- ^ Crevier 1993, стр. 146–148, смотрите также Бьюкенен 2005, п. 56: «Ранние программы обязательно были ограничены объемом и скоростью памяти».

- ^ Моравец 1976. Маккарти всегда были не согласны с Моравцом, вернувшись к их ранним дням вместе в ПАРУСА. Он заявляет: «Я бы сказал, что 50 лет назад возможности машины были слишком малы, но 30 лет назад возможности машины не были реальной проблемой». в CNET интервью. (Навыки 2006 )

- ^ Ханс Моравец, РОБОТ: простая машина для трансцендентного разума

- ^ Рассел и Норвиг, 2003 г., стр. 9,21–22 и Лайтхилл 1973

- ^ МакКордак 2004, стр. 300 и 421; Crevier 1993, стр. 113–114; Моравец 1988, п. 13; Ленат и Гуха 1989, (Введение); Рассел и Норвиг, 2003 г., п. 21 год

- ^ МакКордак 2004, п. 456, г. Моравец 1988, стр. 15–16

- ^ Маккарти и Хейс 1969, Crevier 1993, стр. 117–119

- ^ МакКордак 2004, стр. 280–281, Crevier 1993, п. 110, Рассел и Норвиг, 2003 г., п. 21 год и NRC 1999 в разделе «Успех в распознавании речи».

- ^ Crevier 1993, п. 117, Рассел и Норвиг, 2003 г., п. 22, Хау 1994 и смотрите также Лайтхилл 1973.

- ^ Рассел и Норвиг, 2003 г., п. 22, Лайтхилл 1973, Джон Маккарти написал в ответ, что «проблема комбинаторного взрыва признавалась в ИИ с самого начала» в Обзор отчета Lighthill

- ^ Crevier 1993, стр. 115–116 (на ком основан этот аккаунт). Другие виды включают МакКордак 2004, pp. 306–313 и NRC 1999 в разделе «Успех в распознавании речи».

- ^ Crevier 1993, п. 115. Моравек объясняет: «Их первоначальные обещания DARPA были слишком оптимистичными. Конечно, то, что они сделали, существенно не соответствовало этому. Но они чувствовали, что не могут в своем следующем предложении обещать меньше, чем в первом, поэтому они обещали больше. . "

- ^ NRC 1999 в разделе «Переход к прикладным исследованиям увеличивает инвестиции». В то время как автономный танк вышел из строя, система управления боем (называемая «DART ") оказался чрезвычайно успешным, сэкономив миллиарды в первом Война в Персидском заливе, окупив вложения и оправдав DARPA прагматическая политика России, по крайней мере, DARPA был обеспокоен.

- ^ Критика ИИ Лукасом и Пенроузом: Crevier 1993, п. 22, Рассел и Норвиг, 2003 г., стр. 949–950, Хофштадтер 1980, стр. 471–477 и увидеть Лукас 1961

- ^ «Ноу-хау» - это термин Дрейфуса. (Дрейфус проводит различие между «знать как» и «знать это», современная версия Хайдеггер отличие готовый к употреблению и под рукой.) (Дрейфус и Дрейфус 1986 )

- ^ Критика искусственного интеллекта Дрейфусом: МакКордак 2004, стр. 211–239, Crevier 1993, стр. 120–132, Рассел и Норвиг, 2003 г., стр. 950–952 и увидеть Дрейфус 1965, Дрейфус 1972, Дрейфус и Дрейфус 1986

- ^ Критика ИИ Сирлом: МакКордак 2004, стр. 443–445, Crevier 1993, стр. 269–271, Рассел и Норвиг 2004, стр. 958–960 и увидеть Сирл 1980

- ^ Цитируется в Crevier 1993, п. 143

- ^ Цитируется в Crevier 1993, п. 122

- ^ «Я стал единственным членом сообщества искусственного интеллекта, которого видели обедающим с Дрейфусом. И я сознательно дал понять, что это не способ обращения с человеком». Йозеф Вайценбаум, цитируется в Crevier 1993, п. 123.

- ^ Колби, Ватт и Гилберт 1966, п. 148. Вайценбаум ссылался на этот текст в Вайценбаум 1976, pp. 5, 6. Позже Колби и его коллеги также разработали болтун -подобное "компьютерное моделирование параноидальных процессов" (ПАРИРОВАТЬ ) «сделать понятные параноидальные процессы в явных терминах обработки символов».Колби 1974, п. 6)

- ^ Критика ИИ Вайценбаумом: МакКордак 2004, стр. 356–373, Crevier 1993, стр. 132–144, Рассел и Норвиг, 2003 г., п. 961 и увидеть Вайценбаум 1976

- ^ МакКордак 2004, п. 51, Рассел и Норвиг, 2003 г., стр.19, 23

- ^ МакКордак 2004, п. 51, Crevier 1993, стр. 190–192

- ^ Crevier 1993, стр. 193–196

- ^ Crevier 1993, стр. 145–149,258–63

- ^ Уэйсон (1966) показали, что люди плохо справляются с полностью абстрактными проблемами, но если проблема будет переформулирована, чтобы позволить использовать интуитивно понятные социальный интеллект, производительность резко улучшается. (Увидеть Задача выбора Wason ) Тверски, Слович и Канеманн (1982) показали, что люди ужасны в элементарных задачах, связанных с неопределенными рассуждениями. (Увидеть список когнитивных предубеждений для нескольких примеров). Элеонора Рош работа описана в Лакофф 1987

- ^ Ранний пример Маккэти позиция была в журнале Наука где он сказал: «Это ИИ, поэтому нам все равно, реально ли он психологически» (Колата 2012 ), и недавно он подтвердил свою позицию на AI @ 50 конференция, на которой он сказал: «Искусственный интеллект по определению не симуляция человеческого интеллекта»Производитель 2006 ).

- ^ Crevier 1993, стр.175

- ^ Аккуратный против неряшливого: МакКордак 2004, pp. 421–424 (который поднимает состояние дебатов в 1984 г.). Crevier 1993, стр.168 (который документирует первоначальное использование этого термина Шенком). Другой аспект конфликта назывался «процедурное / декларативное различие», но не оказал влияния на более поздние исследования ИИ.

- ^ МакКордак 2004, стр. 305–306, Crevier 1993, стр. 170–173, 246 и Рассел и Норвиг, 2003 г., п. 24. Рамочная бумага Минского: Минский 1974.

- ^ Ньюквист 1994, стр. 189–192

- ^ МакКордак 2004, стр. 327–335 (Дендраль ), Crevier 1993, стр. 148–159, Ньюквист 1994, п. 271, Рассел и Норвиг, 2003 г., стр. 22–23

- ^ Crevier 1993, стр. 158–159 и Рассел и Норвиг, 2003 г., п. 23−24

- ^ Crevier 1993, п. 198

- ^ МакКордак 2004, стр. 434–435, Crevier 1993, стр. 161–162,197–203 и Рассел и Норвиг, 2003 г., п. 24

- ^ МакКордак 2004, п. 299

- ^ МакКордак 2004, стр.421

- ^ Революция знаний: МакКордак 2004, стр. 266–276, 298–300, 314, 421, Ньюквист 1994, стр. 255–267, Рассел и Норвиг, стр. 22–23

- ^ Цикл: МакКордак 2004, п. 489, г. Crevier 1993, стр. 239–243, Ньюквист 1994, стр. 431–455, Рассел и Норвиг, 2003 г., п. 363−365 и Ленат и Гуха 1989

- ^ «Шахматы: Мат» (PDF). Получено 1 сентября 2007.

- ^ МакКордак 2004, стр. 436–441, Ньюквист 1994, стр. 231–240, Crevier 1993, стр.211, Рассел и Норвиг, 2003 г., п. 24 и смотрите также Фейгенбаум и МакКордак, 1983 г.

- ^ Crevier 1993, стр.195

- ^ Crevier 1993, стр.240.

- ^ а б c Рассел и Норвиг, 2003 г., п. 25

- ^ МакКордак 2004, стр. 426–432, NRC 1999 в разделе «Переход к прикладным исследованиям увеличивает инвестиции»

- ^ Crevier 1993, стр. 214–215.

- ^ Crevier 1993, стр. 215–216.

- ^ Мид, Карвер А .; Исмаил, Мохаммед (8 мая 1989 г.). Аналоговая реализация нейронных систем на СБИС (PDF). Международная серия Kluwer в области инженерии и информатики. 80. Норвелл, Массачусетс: Kluwer Academic Publishers. Дои:10.1007/978-1-4613-1639-8. ISBN 978-1-4613-1639-8.

- ^ Crevier 1993, стр.203. AI зима впервые использовалось как название семинара по теме для Ассоциация развития искусственного интеллекта.

- ^ Ньюквист 1994, стр. 359–379, МакКордак 2004, п. 435, Crevier 1993, стр. 209–210

- ^ МакКордак 2004, п. 435 (который приводит институциональные причины их окончательной неудачи), Ньюквист 1994, стр. 258–283 (который ссылается на ограниченное развертывание внутри корпораций), Crevier 1993, стр. 204–208 (который ссылается на сложность поддержания истины, т.е. обучения и обновления), Ленат и Гуха 1989, Введение (подчеркивающее хрупкость и неспособность справиться с чрезмерной квалификацией.)

- ^ МакКордак 2004, стр. 430–431

- ^ а б МакКордак 2004, п. 441, г. Crevier 1993, п. 212. МакКордак пишет: «Два с половиной десятилетия спустя мы видим, что японцы не совсем достигли всех этих амбициозных целей».

- ^ Ньюквист, HP (1994). Создатели мозга: гений, эгоизм и жадность в поисках мыслящих машин. Нью-Йорк: Macmillan / SAMS. ISBN 978-0-672-30412-5.

- ^ МакКордак 2004, стр. 454–462

- ^ Моравец (1988 г., п. 20) пишет: «Я уверен, что этот восходящий путь к искусственному интеллекту однажды встретит более чем половину пути, ведущего к традиционному нисходящему пути, готовый предоставить реальную компетенцию и здравый смысл, который так удручающе неуловим. программы рассуждений. Полностью интеллектуальные машины появятся, когда метафорическое золотой шип движется объединением двух усилий ".

- ^ Crevier 1993, стр. 183–190.

- ^ http://people.csail.mit.edu/brooks/papers/elephants.pdf

- ^ Брукс 1990, п. 3

- ^ См., Например, Лакофф и Тернер 1999

- ^ МакКордак (2004), п. 424) обсуждает фрагментацию и отказ от первоначальных целей ИИ.

- ^ МакКордак 2004, стр. 480–483

- ^ "Темно-синий". IBM Research. Получено 10 сентября 2010.

- ^ DARPA Grand Challenge - главная В архиве 31 октября 2007 г. Wayback Machine

- ^ «Архивная копия». Архивировано из оригинал 5 марта 2014 г.. Получено 25 октября 2011.CS1 maint: заархивированная копия как заголовок (ссылка на сайт)

- ^ Марков, Джон (16 февраля 2011 г.). "На" Jeopardy! " Watson Win почти ничего не значит ". Нью-Йорк Таймс.

- ^ Курцвейл 2005, п. 274 пишет, что улучшение компьютерных шахмат, «согласно общепринятой мудрости, определяется только расширением грубой силы компьютерного оборудования».

- ^ Время цикла Ферранти Марк 1 было 1,2 миллисекунды, что, возможно, эквивалентно примерно 833шлепки. Темно-синий набрал 11,38гигафлопс (и это даже без учета специального оборудования Deep Blue для шахмат). Очень примерно, они различаются в 10 ^ 7 раз.

- ^ МакКордак 2004, стр. 471–478, Рассел и Норвиг, 2003 г., п. 55, где пишут: «В настоящее время широко распространено мнение о том, что весь агент работает в этой сфере». В интеллектуальный агент парадигма обсуждается в основных учебниках по ИИ, таких как: Рассел и Норвиг, 2003 г., стр. 32–58, 968–972, Пул, Макворт и Гебель, 1998 г., стр. 7–21, Люгер и Стаблфилд 2004, стр. 235–240

- ^ Карл Хьюитт с Актерская модель предвосхитил современное определение интеллектуальных агентов. (Хьюитт, Бишоп и Штайгер, 1973 г. ) Оба Джон Дойл (Дойл 1983 ) и Марвин Мински популярная классика Общество разума (Минский 1986 ) использовали слово «агент». Включены другие "модульные" предложения Родни Брукс архитектура подчинения, объектно-ориентированного программирования и другие.

- ^ а б Рассел и Норвиг, 2003 г., стр.27, 55

- ^ Так определяют искусственный интеллект в наиболее распространенных учебниках 21 века. Увидеть Рассел и Норвиг, 2003 г., п. 32 и Пул, Макворт и Гебель, 1998 г., п. 1

- ^ МакКордак 2004, п. 478

- ^ МакКордак 2004, стр. 486–487, Рассел и Норвиг, 2003 г., стр. 25–26

- ^ а б Рассел и Норвиг, 2003 г., п. 25−26

- ^ МакКордак (2004), п. 487): «Пока я пишу, ИИ пользуется гегемонией Чистой».

- ^ Жемчуг 1988

- ^ Увидеть Применение искусственного интеллекта § Информатика

- ^ NRC 1999 в разделе «Искусственный интеллект в 90-е годы» и Курцвейл 2005, п. 264

- ^ Рассел и Норвиг, 2003 г., п. 28

- ^ Информацию о новейших достижениях в области распознавания речи на основе ИИ см. Экономист (2007)

- ^ а б «Системы на основе искусственного интеллекта уже стали неотъемлемой частью многих повседневных технологий, таких как поисковые системы в Интернете, банковское программное обеспечение для обработки транзакций и медицинской диагностики». Ник Бостром, цитируется в CNN 2006

- ^ Олсен (2004),Олсен (2006)

- ^ МакКордак 2004, п. 423, г. Курцвейл 2005, п. 265, Хофштадтер 1979, п. 601

- ^ CNN 2006

- ^ Марков 2005

- ^ Экономист 2007

- ^ Таскарелла 2006

- ^ Crevier 1993, стр. 108–109

- ^ Далее он говорит: «Я считаю, что мы могли бы ... Однажды я был на международной конференции по нейронным сетям. Было 40 тысяч зарегистрированных пользователей ... но ... если бы у вас была международная конференция. конференции, например, об использовании нескольких представлений для здравого смысла, я смог найти только 6 или 7 человек во всем мире ». Минский 2001

- ^ Производитель 2006

- ^ Курцвейл 2005

- ^ Хокинс и Блейксли 2004

- ^ Стив Лор (17 октября 2016 г.), «IBM делает ставку на Ватсона и платит за это большие деньги», Газета "Нью-Йорк Таймс

- ^ Хэмптон, Стефани Э; Штрассер, Карли А; Тьюксбери, Джошуа Дж; Грамм, Венди К.; Бадден, Эмбер Э; Батчеллер, Арчер Л; Герцог, Клиффорд С; Портер, Джон Х (1 апреля 2013 г.). «Большие данные и будущее экологии». Границы экологии и окружающей среды. 11 (3): 156–162. Дои:10.1890/120103. ISSN 1540-9309.